ওপেনএআই-এর যুদ্ধ বিভাগের সাথে বিতর্কিত চুক্তি নিয়ে স্যাম অল্টম্যানের AMA-এর সারসংক্ষেপ

শুক্রবার গভীর রাতে, মধ্যপ্রাচ্যে ভূ-রাজনৈতিক উত্তেজনা প্রকাশ্য সংঘর্ষে রূপ নেওয়ার সাথে সাথে, স্যাম অল্টম্যান X-এ একটি চুক্তি ঘোষণা করতে এগিয়ে আসেন যা প্রযুক্তি সম্প্রদায়ের অনেকে দীর্ঘদিন ধরে ভয় পেয়েছিল, তবুও খুব কমই আশা করেছিল যে এটি এত আকস্মিকভাবে বাস্তবায়িত হবে।

OpenAI আনুষ্ঠানিকভাবে মার্কিন যুদ্ধ বিভাগ (DoW) এর সাথে একটি চুক্তি স্বাক্ষর করেছে যাতে সামরিক বাহিনীর সবচেয়ে সংবেদনশীল, শ্রেণীবদ্ধ নেটওয়ার্কগুলির মধ্যে তার ফ্রন্টিয়ার মডেলগুলি স্থাপন করা যায়।

এই ঘোষণাটি তাৎক্ষণিক এবং বিশৃঙ্খল ঝড় তুলেছিল। কয়েক মিনিটের মধ্যে, থ্রেডটি "Cancel ChatGPT" হ্যাশট্যাগ, জাতীয় নিরাপত্তা বিশেষজ্ঞদের তীক্ষ্ণ জিজ্ঞাসা এবং মানবতার ভবিষ্যত বিক্রি করে দেওয়ার প্রদাহজনক অভিযোগের যুদ্ধক্ষেত্রে পরিণত হয়েছিল।

একটি কোম্পানির জন্য যা AGI সকল মানবতার উপকার নিশ্চিত করার নীতির উপর প্রতিষ্ঠিত হয়েছিল, একটি প্রধান প্রতিরক্ষা ঠিকাদারে পরিবর্তন শিল্পের নৈতিক ভূদৃশ্যে একটি টেকটোনিক পরিবর্তনের মতো মনে হয়েছিল।

এই আকস্মিক পরিবর্তনের প্রেক্ষাপট চুক্তির মতোই নাটকীয়। অল্টম্যানের ঘোষণার মাত্র কয়েক ঘণ্টা আগে, রাষ্ট্রপতি ডোনাল্ড ট্রাম্প একটি ব্যাপক নির্বাহী আদেশ জারি করেন যা সমস্ত ফেডারেল সংস্থাকে Anthropic থেকে প্রযুক্তি ব্যবহার অবিলম্বে বন্ধ করার নির্দেশ দেয়, যা OpenAI-এর প্রধান প্রতিদ্বন্দ্বী।

যুদ্ধ সচিব পিট হেগসেথ Anthropic-কে "জাতীয় নিরাপত্তার জন্য সরবরাহ-শৃঙ্খল ঝুঁকি" হিসেবে চিহ্নিত করেছেন, একটি পদবী যা সাধারণত Huawei-এর মতো বিদেশী প্রতিপক্ষদের জন্য সংরক্ষিত।

Anthropic রিপোর্ট অনুসারে পেন্টাগনকে তার Claude মডেলগুলিতে নিঃশর্ত প্রবেশাধিকার দিতে অস্বীকার করেছিল, চুক্তিভিত্তিক "লাল রেখা"-এর উপর জোর দিয়ে যা ঘরোয়া ব্যাপক নজরদারি বা সম্পূর্ণ স্বায়ত্তশাসিত মারাত্মক অস্ত্রের জন্য প্রযুক্তির ব্যবহার নিষিদ্ধ করবে।

স্যাম অল্টম্যান, OpenAI-এর CEO

স্যাম অল্টম্যান, OpenAI-এর CEO

OpenAI তার প্রতিদ্বন্দ্বীর প্রস্থানের ফলে সৃষ্ট শূন্যতায় পা রাখল। প্রশাসন দাবি করেছিল যে AI মডেলগুলি "সমস্ত বৈধ উদ্দেশ্যের জন্য" উপলব্ধ থাকা উচিত, OpenAI তার প্রবেশকে একটি আত্মসমর্পণ হিসাবে নয় বরং একটি পরিশীলিত সমঝোতা হিসাবে উপস্থাপন করেছে।

তার Ask Me Anything (AMA)-তে, অল্টম্যান দাবি করেন যে OpenAI একই নিরাপত্তা সুরক্ষা ব্যবস্থা নিশ্চিত করেছে যা Anthropic চেয়েছিল কিন্তু একটি আল্টিমেটামের পরিবর্তে একটি বহু-স্তরীয় পদ্ধতির মাধ্যমে সেগুলি অর্জন করেছে।

বিদ্যমান আইনি কাঠামোর মধ্যে কাজ করতে সম্মত হয়ে, চতুর্থ সংশোধনী এবং Posse Comitatus আইন উল্লেখ করে, OpenAI কার্যকরভাবে একটি সংঘর্ষ প্রশমিত করেছে যা একটি সক্রিয় যুদ্ধের সময় মার্কিন সামরিক বাহিনীকে ফ্রন্টিয়ার AI ক্ষমতা ছাড়া রাখার হুমকি দিয়েছিল।

OpenAI অল্টম্যানের থ্রেড থেকে মূল বিষয়বস্তু

থ্রেডটি দ্রুত কর্পোরেট PR থেকে AI যুদ্ধের নৈতিকতার উপর একটি কাঁচা বিতর্কে চলে গেছে। সবচেয়ে বেশি পছন্দ করা প্রশ্নগুলির মধ্যে একটি OpenAI-এর মিশনে মৌলিক পরিবর্তনকে সম্বোধন করেছে: কেন "মানব উন্নতি" থেকে প্রতিরক্ষা সহযোগিতায় সরে যাওয়া?

অল্টম্যানের প্রতিক্রিয়া চরিত্রগতভাবে বাস্তবধর্মী ছিল: "বিশ্ব একটি জটিল, অগোছালো এবং কখনও কখনও বিপজ্জনক জায়গা। আমরা বিশ্বাস করি দেশ রক্ষার জন্য দায়ী ব্যক্তিদের সর্বোত্তম উপলব্ধ সরঞ্জামে প্রবেশাধিকার থাকা উচিত।"

অল্টম্যান AI-কে একটি স্বায়ত্তশাসিত জল্লাদ হওয়া থেকে রোধ করার জন্য ডিজাইন করা প্রযুক্তিগত সুরক্ষা ব্যবস্থার বিস্তারিত বর্ণনা করেছেন।

এর মধ্যে রয়েছে একটি "ক্লাউড-অনলি" স্থাপনা কৌশল, মডেলগুলিকে সরাসরি এজ ডিভাইস বা অস্ত্র হার্ডওয়্যারে এম্বেড করা থেকে বিরত রাখা, এবং শ্রেণীবদ্ধ ব্যবহার তদারকি করার জন্য "ফিল্ড ডিপ্লয়মেন্ট ইঞ্জিনিয়ার" (FDE) নিয়োগ।

তবে, থ্রেডটি সন্দেহজনক রয়ে গেছে। সমালোচকরা একটি কমিউনিটি নোট তুলে ধরেছেন যা উল্লেখ করে যে USA PATRIOT আইনের অধীনে, "বৈধ ব্যবহার" এখনও বিশাল ডেটা সংগ্রহ অন্তর্ভুক্ত করতে পারে।

যখন AI একটি বৈশ্বিক বিপর্যয় ঘটানোর সম্ভাবনা সম্পর্কে জিজ্ঞাসা করা হয়েছিল, অল্টম্যান অস্বাভাবিকভাবে সংক্ষিপ্ত ছিলেন, পরামর্শ দিয়েছিলেন যে জাতীয় নিরাপত্তা সহযোগিতা প্রকৃতপক্ষে রাষ্ট্র এবং ডেভেলপারদের একই পৃষ্ঠায় রেখে ঝুঁকি কমাতে পারে।

সবচেয়ে প্রকাশক আদান-প্রদানগুলির মধ্যে একটি শাসনকে জড়িত করেছিল। যখন জিজ্ঞাসা করা হয়েছিল যে ফেডারেল সরকার শেষ পর্যন্ত OpenAI জাতীয়করণ করতে পারে কিনা, অল্টম্যান স্বীকার করেছেন, "আমি অবশ্যই এটি সম্পর্কে চিন্তা করেছি, কিন্তু বর্তমান গতিপথে এটি অত্যন্ত সম্ভাব্য মনে হয় না।"

এই স্বীকারোক্তি তাদের সান্ত্বনা দিতে খুব কমই সাহায্য করেছিল যারা যুদ্ধ বিভাগের পুনঃব্র্যান্ডিং এবং Anthropic কালো তালিকাভুক্তিকে একটি রাষ্ট্র-পরিচালিত AGI-এর দিকে প্রথম পদক্ষেপ হিসাবে দেখেন।

নৈতিকতা, নজির এবং নিয়ন্ত্রণের ক্ষতি

এই চুক্তির প্রভাব একটি একক চুক্তির বাইরে অনেক দূর প্রসারিত। তার প্রতিযোগীর সরবরাহ শৃঙ্খল ঝুঁকি পদবী গ্রহণ করে, OpenAI পরোক্ষভাবে একটি বিশ্বকে বৈধ করেছে যেখানে সরকার একটি কোম্পানির সামরিক উপযোগিতার প্রতি আদর্শগত প্রতিশ্রুতির ভিত্তিতে বিজয়ী এবং হেরে যাওয়া লোক বাছাই করতে পারে।

এটি একটি ভীতিকর নজির স্থাপন করে, যেমনটি এমনকি অল্টম্যান স্বীকার করেছেন, যেখানে বেসরকারি কোম্পানিগুলি জাতীয় নিরাপত্তা হুমকি হিসাবে চিহ্নিত হওয়া এড়াতে তাদের নৈতিক সুরক্ষা ব্যবস্থা কমাতে চাপ অনুভব করতে পারে।

একটি নৈতিক দৃষ্টিকোণ থেকে, হিউম্যান-ইন-দ্য-লুপ প্রয়োজনীয়তা সবচেয়ে বিতর্কিত বিষয় হিসেবে রয়ে গেছে।

যদিও OpenAI জোর দিয়ে বলছে যে মানুষ শক্তি প্রয়োগের জন্য দায়িত্ব বজায় রাখবে, থ্রেডের প্রতিরক্ষা বিশেষজ্ঞরা উল্লেখ করেছেন যে বর্তমান DoW নীতি (Directive 3000.09) উচ্চ-গতির ডিজিটাল যুদ্ধে অর্থবহ মানব নিয়ন্ত্রণ কী গঠন করে সে সম্পর্কে কুখ্যাতভাবে অস্পষ্ট।

স্যাম অল্টম্যান

স্যাম অল্টম্যান

যদি একটি AI একজন মানুষের চোখের পলক ফেলার চেয়ে দ্রুত লক্ষ্য ডেটা প্রক্রিয়া করে, তাহলে মানুষটি কি সত্যিই লুপে আছে নাকি কেবলমাত্র একটি মেশিনের সিদ্ধান্তের জন্য একটি রাবার স্ট্যাম্প?

AGI নিয়ন্ত্রণ হারানোর ঝুঁকি আর দূর ভবিষ্যতের জন্য একটি তাত্ত্বিক উদ্বেগ নয়; এটি একটি প্রশ্ন যে এই মডেলগুলি শ্রেণীবদ্ধ যুদ্ধের উচ্চ-ঝুঁকিপূর্ণ পরিবেশে কীভাবে আচরণ করবে।

এছাড়াও পড়ুন: OpenAI AI বৃদ্ধি করতে Amazon, NVIDIA এবং SoftBank থেকে রেকর্ড $১১০ বিলিয়ন সংগ্রহ করেছে

যেমন AMA শেষ হয়েছে, OpenAI ব্যবহারকারীদের স্মৃতিতে অল্টম্যানের চিত্রটি একজন তারা-চোখ প্রযুক্তি দূরদর্শীর নয়, বরং কঠিন শক্তির বিশ্বে নেভিগেট করা একজন ডিজিটাল কূটনীতিকের ছিল।

তিনি থ্রেডটি একটি গুরুত্বপূর্ণ উপসংহার দিয়ে ছেড়ে গেছেন: নিরপেক্ষ AI উন্নয়নের যুগ শেষ। OpenAI-এর যুদ্ধ বিভাগের সাথে একীভূত হওয়ার সিদ্ধান্ত একটি নতুন অধ্যায়ের সূচনা চিহ্নিত করে যেখানে AGI একটি বৈশ্বিক জনসাধারণের পণ্যের পরিবর্তে রাষ্ট্রের একটি কৌশলগত সম্পদ হিসাবে বিবেচিত হয়।

পোস্টটি যুদ্ধ বিভাগের সাথে OpenAI-এর বিতর্কিত চুক্তির উপর স্যাম অল্টম্যানের AMA-এর সারসংক্ষেপ প্রথমবার Technext-এ প্রকাশিত হয়েছে।

আপনি আরও পছন্দ করতে পারেন

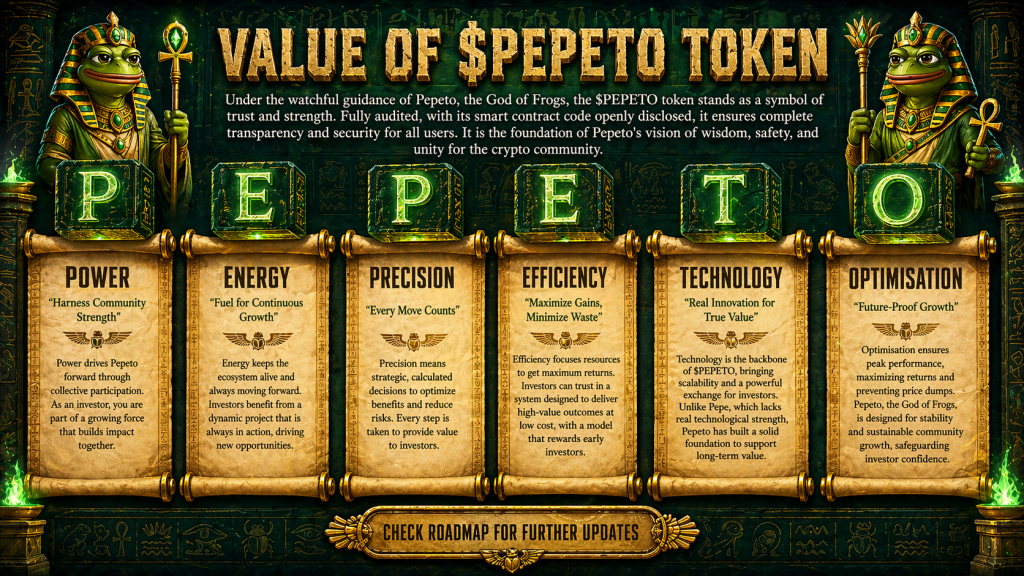

Avax মূল্য পূর্বাভাস কি $55 ছুঁতে পারবে Pepeto সেই ঘটনায় পৌঁছানোর আগে যা সবকিছু পরিবর্তন করে দেবে

সোনার মূল্য সতর্কতা: $4,800-এ প্রত্যাখ্যান $4,100-এ সম্ভাব্য ধসের ইঙ্গিত দিচ্ছে