Claude AIのパラドックス:米軍がイラン紛争でAnthropicのシステムを配備する一方、防衛請負業者は撤退

BitcoinWorld

Claude AIのパラドックス: 米軍がイラン紛争でAnthropicのシステムを配備する一方、防衛請負業者が離脱

ワシントンD.C. — 2025年6月9日: 米軍がイランとの進行中の紛争において標的決定のためにAnthropicのClaude人工知能システムを積極的に配備している一方で、主要な防衛請負業者やサブ請負業者が急速にプラットフォームを放棄するという、防衛技術における顕著なパラドックスが浮上している。この矛盾した状況は、重複する政府の制限と進化する防衛政策が軍産複合体全体に運用上の混乱を引き起こしたことに起因する。

進行中の紛争におけるClaude AIの軍事配備

最近の報告によると、米軍はイランの陣地に対する重要な標的作戦のためにAnthropicのClaude AIシステムを引き続き利用している。具体的には、国防総省の職員は、PalantirのMavenシステムと連携して人工知能プラットフォームを使用し、空爆を計画・実行している。これらの統合システムは数百の潜在的な標的を提案し、正確な位置座標を発行し、戦略的重要性に応じて目標に優先順位を付ける。

ワシントンポストの報道により、このシステムが進行中の軍事作戦において「リアルタイム標的設定と標的優先順位付け」のために機能していることが明らかになった。その結果、Anthropicの技術は、その軍事応用をめぐる論争が高まっているにもかかわらず、戦闘決定を直接支援している。政治的指令が政府機関全体での配備を制限することを目指しているにもかかわらず、システムの継続使用が発生している。

政府の矛盾する制限

トランプ大統領は最近、民間機関にAnthropic製品の使用を直ちに中止するよう指示した。しかし、国防総省は異なる指示を受けた。国防当局は、AI企業との業務を縮小するための6か月の猶予期間を得た。この矛盾する指針は、防衛機関全体に運用上の混乱を引き起こした。

さらに、これらの制限のタイミングは特に問題があることが判明した。大統領指令の翌日、米国とイスラエルの部隊がテヘランに対して奇襲攻撃を開始した。この軍事行動は、政権がその政策変更を完全に実施する前に、継続的な紛争を開始した。その結果、Anthropicモデルが潜在的な禁止に直面しながらも活発な戦闘を支援するという運用上の現実が生まれた。

防衛請負業者がClaude AIを急速に放棄

主要な防衛産業プレーヤーは今週、Anthropicモデルを競合するAIシステムに積極的に置き換えている。ロイターの報道によると、ロッキード・マーティンがこの移行をリードしている。他の防衛請負業者も、Claude AIプラットフォームから離れる同様の道をたどっている。この企業の移動は、防衛サプライチェーン全体に大きな混乱を引き起こしている。

さらに、多数のサブ請負業者がAI調達に関して困難な決定に直面している。J2 Venturesのマネージングパートナーは、CNBCに対し、10社のポートフォリオ企業が「防衛用途でのClaudeの使用から撤退した」と語った。これらの企業は現在、代替の人工知能ソリューションでサービスを置き換えるための積極的なプロセスに取り組んでいる。その結果、防衛技術セクターは急速な再構成を経験している。

| 組織 | 取られた措置 | タイムライン |

|---|---|---|

| ロッキード・マーティン | Claudeを競合他社に置き換え | 今週 |

| J2 Venturesポートフォリオ企業 | 10社がClaudeから撤退 | 積極的な置き換えプロセス |

| 国防総省 | 6か月の縮小期間で使用継続 | 進行中の紛争作戦 |

| 民間機関 | 直ちに使用中止 | 大統領指令 |

サプライチェーンリスク指定が迫る

ピート・ヘグセス国防長官は、Anthropicをサプライチェーンリスクとして指定することを約束している。しかし、この指定に向けた公式な措置はまだ具体化していない。その結果、現在、Claudeシステムの軍事使用を妨げる法的障壁は存在しない。この規制上の不確実性は、防衛計画者と請負業者の両方に運用上の課題を引き起こしている。

潜在的な指定は、Anthropicとその支持者からの激しい法的異議申し立てを引き起こす可能性が高い。法律専門家は、人工知能調達と国家安全保障要件に関する複雑な訴訟を予想している。一方、軍事作戦は、まもなく正式な制限に直面する可能性のある技術に依存し続けている。

軍事AI採用に対するより広範な影響

この状況は、軍事人工知能採用における根本的な緊張を浮き彫りにする。現在の論争からいくつかの重要な問題が浮上している:

- 運用継続性と政策遵守: 軍事部隊は活発な紛争中に安定したシステムを必要とする一方、政策立案者はより広範な戦略目標との整合を求める。

- 請負業者のリスクコントロール: 防衛企業は、技術能力と規制遵守および世論とのバランスを取る必要がある。

- 戦争におけるAI倫理: 標的決定のための人工知能の使用は、自律型兵器システムに関する重要な倫理的問題を提起する。

- 政府調達の調整: 民間機関と軍事機関の間の矛盾する指令は、実施上の課題を生み出す。

さらに、請負業者の急速な離脱は、政策の不確実性が防衛技術市場をどのように不安定化させるかを示している。規制の基盤が予期せず変化すると、企業は長期的な開発ロードマップを維持できない。この不安定性は、最終的に軍事技術の進歩を妨げる可能性がある。

軍事技術論争の歴史的背景

以前の防衛技術論争は、現在の出来事を理解するための関連する文脈を提供する。国防総省のProject Maven構想は、人工知能倫理に関して同様の精査に直面した。さらに、Googleの従業員は2018年に同社の軍事AI作業に抗議し、政策変更につながった。これらの歴史的先例は、防衛応用における技術能力と倫理的考慮事項の間の繰り返される緊張を示している。

さらに、現在の状況は、民間および軍事応用の両方を持つ「デュアルユース」技術に関するより広範な議論を反映している。商業目的で開発された人工知能システムは、ますます軍事応用を見つけており、複雑な規制上の課題を生み出している。このトレンドは、AI能力がセクター全体で進歩するにつれて、おそらく継続するだろう。

軍事AIシステムの技術能力

Claudeのような現代の軍事人工知能システムは、驚くべき技術能力を示している。これらのシステムは、潜在的な標的を特定するために膨大な量のインテリジェンスデータを処理する。衛星画像、信号情報、人間の情報報告を同時に分析する。さらに、以下を含む複数の戦略的要因に基づいて標的に優先順位を付ける:

- 敵の作戦に対する戦略的価値

- 巻き添え被害のリスク評価

- 情報の適時性

- 利用可能な攻撃資産と能力

- 政治的および外交的考慮事項

これらのシステムはますます自律性を持って動作するが、人間のオペレーターが最終的な決定権限を維持する。ClaudeとPalantirのMavenシステムの統合は、現在の最先端の軍事AI配備を表している。この技術的洗練度により、システムが運用可能になると、置き換えが困難になる。

業界の対応と代替ソリューション

防衛請負業者は、Claudeから離れるにつれて、複数の代替人工知能ソリューションを探求している。いくつかの企業は、軍事応用のための社内AI能力を開発している。他の企業は、政府契約に専念する専門の防衛AI企業と提携している。この多様化戦略は、単一のAIプロバイダーへの依存を減らすことを目的としている。

一方、より広範なAI業界は、これらの開発を注意深く観察している。テクノロジー企業は、潜在的な論争にもかかわらず、防衛契約を追求するかどうかを決定する必要がある。一部の企業は軍事作業に反対する明確な方針を確立し、他の企業は政府ビジネスのための専門部門を作成している。これらの戦略的決定は、今後数年間の防衛技術開発を形作るだろう。

軍事AIに関する国際的な視点

米国の軍事AI配備に対する世界的な反応は大きく異なる。同盟国は、自国の防衛技術戦略への洞察を得るために、これらの開発を監視している。敵対国は、おそらく対応として軍事AIプログラムを加速させている。国際社会は、自律型兵器システムの適切なガバナンスフレームワークについて議論を続けている。

致死的自律型兵器システムに関する国連の議論は、これらの開発の中で新たな緊急性を得ている。国際規範を確立するための外交努力は、異なる国家安全保障の優先順位のために課題に直面している。しかし、ほとんどの国は、軍事AI応用に対する何らかの形のガバナンスフレームワークの必要性を認識している。

結論

Claude AIのパラドックスは、現代の防衛技術採用における根本的な緊張を明らかにする。米軍は、イラン紛争における標的決定のためにAnthropicのシステムを配備し続けている一方で、防衛請負業者は急速にプラットフォームを放棄している。この矛盾した状況は、重複する政府の制限と進化する防衛政策に起因する。ヘグセス長官の潜在的なサプライチェーンリスク指定は、軍事作戦が技術に依存し続けている間に法的異議申し立てを引き起こす可能性がある。最終的に、この論争は、軍事人工知能応用における技術能力、倫理的考慮事項、および政策遵守のバランスを取ることにおけるより広範な課題を浮き彫りにする。これらの複雑な問題が進化するにつれて、防衛技術セクターはおそらく継続的な混乱に直面するだろう。

よくある質問

Q1: 制限があるのに、なぜ米軍はまだClaude AIを使用しているのですか?

軍は6か月の縮小期間を受けた一方で、民間機関は即座の制限に直面しました。イランとの進行中の紛争は、この移行期間中の継続使用の運用上の必要性を生み出しました。

Q2: どの防衛請負業者がClaude AIを置き換えていますか?

ロッキード・マーティンがAnthropicのプラットフォームからの移行をリードしており、多数の他の請負業者と少なくとも10社のJ2 Venturesポートフォリオ企業が同様の道をたどっています。

Q3: 「サプライチェーンリスク指定」はAnthropicにとって何を意味しますか?

この指定は、Anthropicを防衛サプライチェーンにおける潜在的なセキュリティリスクとして正式に特定し、将来の国防総省契約を潜在的に禁止し、既存の契約に対する法的課題を生み出すものです。

Q4: Claude AIは実際にどのように軍事標的設定を支援していますか?

このシステムは、インテリジェンスデータを処理して標的を提案し、正確な座標を提供し、戦略的重要性に基づいて目標に優先順位を付けており、PalantirのMavenシステムと連携してリアルタイム標的設定支援を行っています。

Q5: 軍事標的設定にAIを使用することに関する倫理的懸念は何ですか?

懸念には、生死に関わる決定における人間の監視の減少、標的選択におけるアルゴリズムバイアス、エラーの説明責任、および意味のある人間の制御なしに動作する可能性のある自律型兵器システムのより広範な開発が含まれます。

この投稿 Claude AIのパラドックス: 米軍がイラン紛争でAnthropicのシステムを配備する一方、防衛請負業者が離脱 は最初にBitcoinWorldに掲載されました。

関連コンテンツ

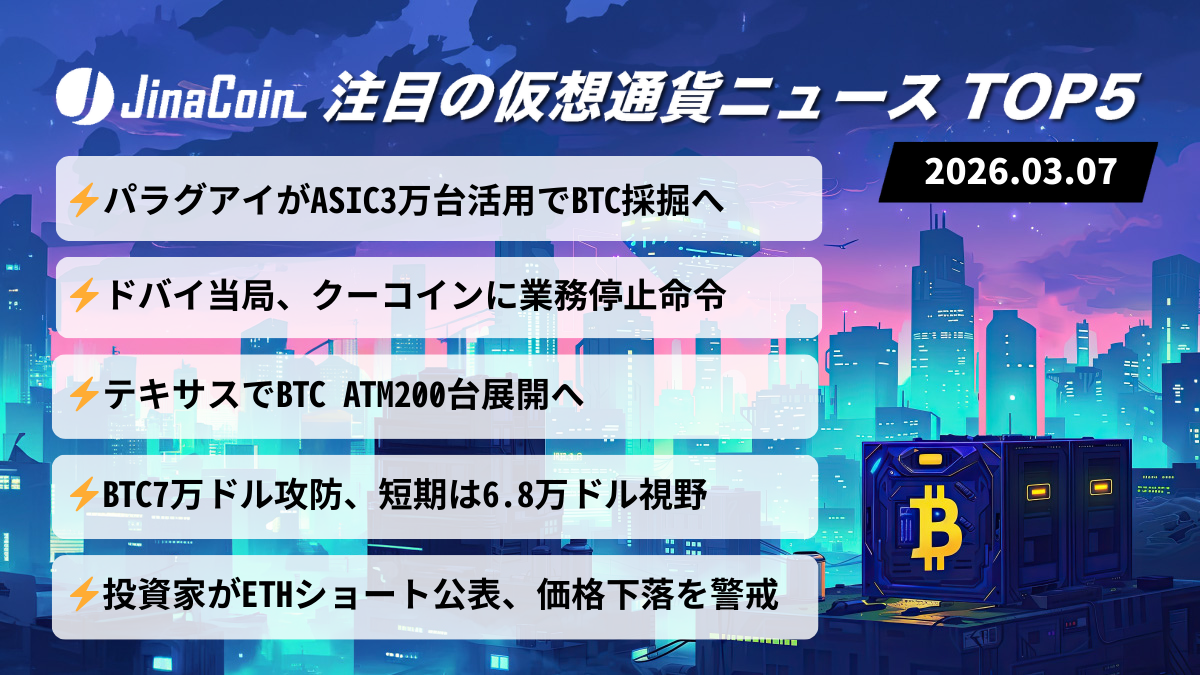

【今日の仮想通貨ニュース】ビットコイン7万ドル攻防で市場警戒感|国家採掘・規制ニュース交錯

エヌビディア株分析:新たな逆風の出現