OpenAI quảng bá ChatGPT cho các quyết định sức khỏe giữa lo ngại về độ chính xác

Terrill Dicki 05/03/2026 01:21

OpenAI nêu bật gia đình sử dụng ChatGPT cho các quyết định điều trị ung thư, nhưng các nghiên cứu gần đây cho thấy các công cụ sức khỏe hỗ trợ bởi AI có vấn đề đáng kể về độ chính xác và an toàn.

OpenAI đã công bố một nghiên cứu điển hình trong tuần này về một gia đình sử dụng ChatGPT để chuẩn bị cho các quyết định điều trị ung thư cho con trai của họ, định vị chatbot hỗ trợ bởi AI như một sự bổ sung cho hướng dẫn của bác sĩ. Thời điểm này gây chú ý khi có ngày càng nhiều bằng chứng cho thấy các công cụ sức khỏe hỗ trợ bởi AI có vấn đề đáng kể về độ tin cậy.

Bài viết quảng cáo, được phát hành vào ngày 4 tháng 3, mô tả cách các bậc cha mẹ tận dụng ChatGPT cùng với nhóm chuyên khoa ung thư của con họ. OpenAI đóng khung điều này như việc sử dụng AI có trách nhiệm—bổ sung chứ không phải thay thế chuyên môn y tế.

Nhưng câu chuyện tích cực này đối mặt với những phát hiện nghiên cứu khó chịu. Một nghiên cứu được công bố trên Nature Medicine xem xét sản phẩm "ChatGPT Health" của chính OpenAI đã phát hiện ra các vấn đề đáng kể về độ chính xác, quy trình an toàn và thiên kiến chủng tộc trong các khuyến nghị y tế. Đó không phải là một cảnh báo nhỏ đối với một công cụ mà mọi người có thể sử dụng khi đưa ra quyết định sống còn về điều trị ung thư.

Vấn đề về độ chính xác

Nghiên cứu độc lập vẽ nên một bức tranh hỗn hợp trong trường hợp tốt nhất. Một nghiên cứu của Mass General Brigham cho thấy ChatGPT đạt độ chính xác khoảng 72% trên các chuyên khoa y tế, tăng lên 77% cho chẩn đoán cuối cùng. Nghe có vẻ ổn cho đến khi bạn xem xét những gì đang bị đe dọa—bạn có lên máy bay với 23% khả năng phi công mắc lỗi nghiêm trọng không?

Công ty AI chăm sóc sức khỏe Atropos đưa ra con số còn ảm đạm hơn: các mô hình ngôn ngữ lớn đa mục đích chỉ cung cấp thông tin liên quan lâm sàng 2% đến 10% thời gian cho các bác sĩ. Khoảng cách giữa "đôi khi hữu ích" và "đủ tin cậy cho các quyết định về ung thư" vẫn còn rất lớn.

Hiệp hội Y khoa Hoa Kỳ đã không ngần ngại lên tiếng. Tổ chức này khuyến cáo không nên bác sĩ sử dụng các công cụ dựa trên LLM để hỗ trợ quyết định lâm sàng, với lý do lo ngại về độ chính xác và thiếu hướng dẫn tiêu chuẩn hóa. Khi AMA nói với các bác sĩ tránh xa, bệnh nhân có lẽ nên lưu ý.

Những gì ChatGPT không thể làm

Chatbot hỗ trợ bởi AI không thể thực hiện khám nghiệm thể chất. Chúng không thể đọc ngôn ngữ cơ thể của bệnh nhân hoặc đặt các câu hỏi theo dõi trực quan mà các bác sĩ chuyên khoa ung thư có kinh nghiệm phát triển qua hàng thập kỷ. Chúng có thể gây ảo giác—tạo ra thông tin nghe có vẻ tự tin nhưng hoàn toàn bịa đặt.

Mối lo ngại về quyền riêng tư tạo thêm một lớp khác. Mọi triệu chứng, mọi nỗi sợ hãi, mọi chi tiết về bệnh ung thư của đứa trẻ được nhập vào ChatGPT trở thành dữ liệu mà người dùng có quyền kiểm soát hạn chế.

Nghiên cứu điển hình của OpenAI nhấn mạnh gia đình đã làm việc "cùng với hướng dẫn chuyên môn từ các bác sĩ." Điều kiện đó quan trọng. Nguy hiểm không phải là bệnh nhân được thông báo đặt câu hỏi tốt hơn—mà là những người dễ bị tổn thương trong khủng hoảng có khả năng phụ thuộc quá mức vào một công cụ mắc sai lầm thường xuyên hơn những gì tiếp thị gợi ý.

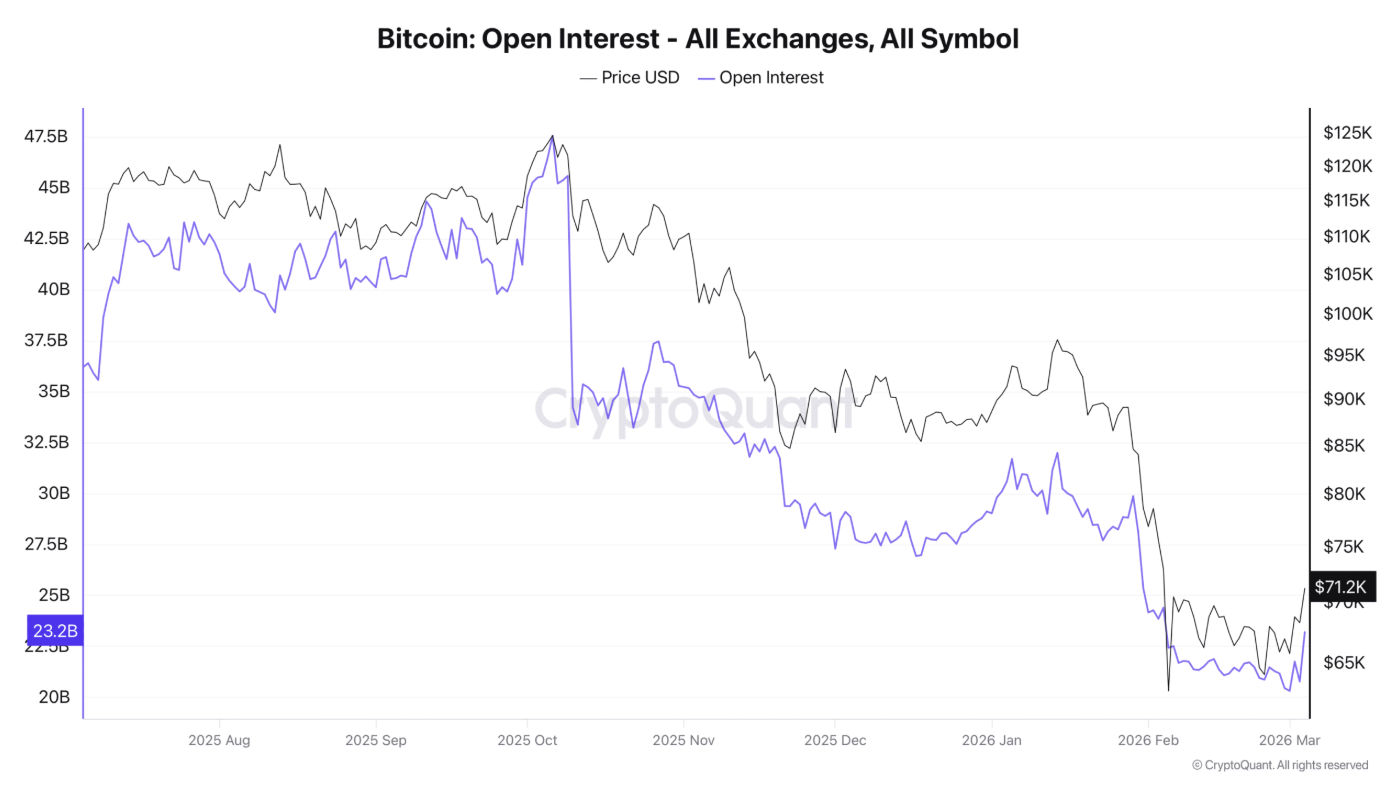

Đối với các nhà đầu tư tiền mã hóa theo dõi tham vọng doanh nghiệp của OpenAI, việc thúc đẩy chăm sóc sức khỏe báo hiệu sự mở rộng mạnh mẽ vào các lĩnh vực có tính cược cao. Liệu các cơ quan quản lý có dung thứ cho các công ty AI quảng bá các công cụ ra quyết định y tế với các vấn đề độ chính xác được ghi nhận hay không vẫn là một câu hỏi mở khi bước vào năm 2026.

Nguồn hình ảnh: Shutterstock- openai

- chatgpt

- ai healthcare

- medical ai

- health tech