Tether推出跨平台BitNet LoRA框架,实现消费级设备上十亿参数AI训练与推理

USDT稳定币发行商Tether宣布推出其所述的首个跨平台LoRA微调框架,专为Microsoft BitNet模型设计,该模型基于1位大型语言模型架构。该功能已集成到其QVAC Fabric系统中,据报道可显著降低内存使用量和计算需求。据该公司表示,这一发展使得大规模语言模型,包括那些拥有数十亿参数的模型,能够使用广泛可用的消费级硬件进行微调,例如笔记本电脑、标准图形处理单元和现代智能手机。

人工智能系统的开发和维护传统上需要企业级硬件,特别是专用的NVIDIA基础设施或基于云的环境。这些要求导致了高昂的运营成本,使得先进AI开发的获取主要局限于拥有雄厚财力和专用计算系统的大型组织。

Tether表示,其QVAC Fabric大型语言模型通过新推出的基于BitNet的框架进行了增强,通过支持跨平台LoRA微调和加速各种异构消费级GPU的推理来解决这些限制。这些硬件包括Intel、AMD和Apple Silicon等。因此,用户能够直接在常见的消费级设备上训练和自定义AI模型,而不是依赖集中式基础设施。

该公司报告称,其工程团队首次成功在移动图形处理单元上演示了BitNet微调,包括Adreno、Mali和Apple Bionic GPU等平台。内部测试表明,一个1.25亿参数的BitNet模型可以在配备Adreno GPU的Samsung S25设备上使用包含约300个文档或约18,000个标记的生物医学数据集在大约十分钟内完成微调。对于10亿参数模型,相同的数据集在Samsung S25上需要约一小时十八分钟,在iPhone 16上需要一小时四十五分钟。该公司还报告称,在最大设备容量条件下,能够在iPhone 16上将测试扩展到高达130亿参数的模型。

边缘AI训练和性能优化的进展

进一步的研究结果表明,该框架可以支持在边缘设备上微调大小是在Q4量化下运行的可比非BitNet模型两倍的模型。这一结果归功于与BitNet架构相关的减少的内存占用。

除了训练方面的改进,该框架还展示了增强的推理性能。在移动设备上进行的测试表明,BitNet模型在GPU上执行时性能显著更快,处理速度比基于CPU的执行快两到十一倍。这些结果表明,移动GPU越来越能够处理以前需要专用硬件或数据中心级资源的工作负载。

该系统还显示出显著的内存效率提升。基准数据表明,使用TQ1_0配置的BitNet-1B模型在推理和LoRA微调过程中所需的VRAM比16位Gemma-3-1B模型少77.8%,比16位Qwen3-0.6B模型少65.6%。这些减少为运行更大的模型和在以前被认为不足的硬件上启用个性化功能提供了额外的容量。

Tether进一步表示,该框架首次在非NVIDIA硬件上为1位大型语言模型引入了LoRA微调功能,将兼容性扩展到AMD、Intel、Apple Silicon和移动GPU平台。通过减少对专用基础设施和云服务的依赖,该方法允许敏感数据保留在用户设备本地存储。该公司指出,这种效率还可能支持联邦学习系统的发展,在该系统中,模型可以在分布式设备上协作训练,同时保持数据隐私并最大限度地减少对集中式系统的依赖。

文章《Tether推出跨平台BitNet LoRA框架,在消费级设备上实现十亿参数AI训练与推理》首次发表于Metaverse Post。

您可能也会喜欢

8万美元的比特币:复苏明确,但牛市信念尚缺

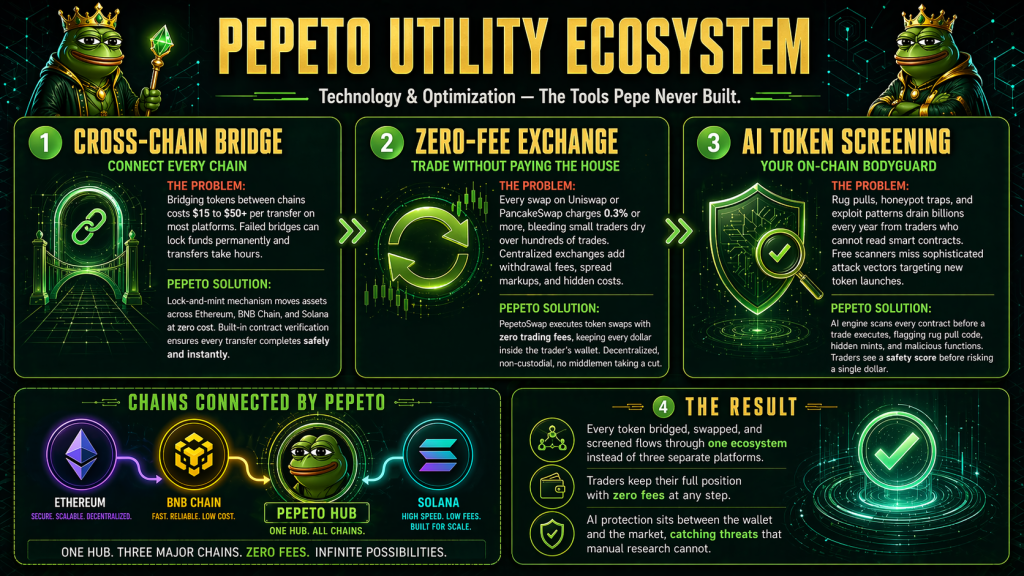

下一个爆发的加密货币:Pepeto目标100倍,而Shiba Inu和BNB仅录得个位数回报