Google 官方宣布,正式推出新一代開放模型系列 Gemma 4。該模型採用與 Gemini 3 相同的技術 […] 〈Google 發布最聰明開放模型 Gemma 4!全面改採 Apache 2.0 授權,效能直逼大型閉源 AI〉這篇文章最早發佈於動區BlockTempo《動區動趨-最具影響力的區塊鏈新聞媒體》。Google 官方宣布,正式推出新一代開放模型系列 Gemma 4。該模型採用與 Gemini 3 相同的技術 […] 〈Google 發布最聰明開放模型 Gemma 4!全面改採 Apache 2.0 授權,效能直逼大型閉源 AI〉這篇文章最早發佈於動區BlockTempo《動區動趨-最具影響力的區塊鏈新聞媒體》。

Google 發布最聰明開放模型 Gemma 4!全面改採 Apache 2.0 授權,效能直逼大型閉源 AI

如需對本內容提供反饋或相關疑問,請通過郵箱 [email protected] 聯絡我們。

Google 官方宣布,正式推出新一代開放模型系列 Gemma 4。該模型採用與 Gemini 3 相同的技術架構,全面轉向商業友好的 Apache 2.0 授權,並主打強大的本地端運行能力。 (前情提要:Google量子電腦傳9分鐘破解比特幣,數字怎麼算出來,真正威脅在哪裡?) (背景補充:AI 預測天災》Google 推出「Groundsource」框架,用 Gemini 將全球新聞轉化為 260 萬筆救命數據) Google 再度為開放原始碼 AI 領域投下震撼彈。官方最新宣布推出「Gemma 4」系列,標榜是目前旗下最智慧的開放模型。Gemma 4 直接承襲了旗艦模型 Gemini 3 的世界級研究技術,帶來突破性的推理能力與代理式(Agentic)工作流程。最受社群矚目的是,Google 這次回應了開發者的呼聲,全面改用商業友好的 Apache 2.0 授權,讓用戶能在任何環境中自由建構與安全部署,完全掌控自身的資料與基礎設施。 We just released Gemma 4 — our most intelligent open models to date. Built from the same world-class research as Gemini 3, Gemma 4 brings breakthrough intelligence directly to your own hardware for advanced reasoning and agentic workflows. Released under a commercially… pic.twitter.com/W6Tvj9CuHW — Google (@Google) April 2, 2026 四大版本齊發,本地端也能順暢運行 為了滿足不同硬體與應用情境,Gemma 4 共釋出四種不同規模的版本。最輕量的 E2B(2B 參數)專為行動裝置與瀏覽器等邊緣裝置設計;E4B(4B 參數)則在效能與效率間取得平衡,更原生支援視覺與音訊輸入。而在高效能端,26B A4B 採用混合專家(MoE)架構,推論時僅啟動約 4B 參數,讓記憶體需求大幅降低,即使在 24GB 記憶體的 Mac Mini 等消費級硬體上也能流暢運行。最高階的 31B 密集模型則是該系列的效能旗艦。 支援 256K 視窗,原生多模態與函式呼叫 在技術規格方面,Gemma 4 的大型模型版本最高支援高達 256K tokens 的上下文視窗,讓開發者能一次處理整個程式碼庫或龐大的文件資料。除了原生支援文字與圖像處理(E2B 與 E4B 更支援音訊),Gemma 4 還具備強大的原生函式呼叫(Function Calling)能力,能夠穩定輸出結構化 JSON 格式,為建構自主代理應用提供了極佳的基礎。此外,其訓練資料涵蓋了超過 140 種語言,具備高度的全球適用性。 效能直逼龐然大物,社群評價亮眼 Gemma 4 強調極高的「每位元組效能」。根據 AI Arena 等開放模型排行榜的數據,Gemma-4-31B 目前高居開放模型第 3 名,整體表現甚至與體積龐大的 Qwen3.5-397B 相當,但其規模卻僅有後者的十分之一。在研究生級推理基準測試(GPQA Diamond)中,31B 版本更創下 84.3% 的驚人成績。 Let’s look at how the open model Gemma has progressed across its last three versions.– Gemma 4 ranks 100 places above Gemma 3– Gemma 3 ranks 87 above Gemma 2 All three models from @GoogleDeepMind are roughly the same size (31B, 27B, 27B), and these gains came only 9 and 13… https://t.co/9JnbveYzwT pic.twitter.com/JQtTz09Y1A — Arena.ai (@arena) April 2, 2026 目前,開發者已可在 Google AI Studio 上直接體驗 Gemma 4,或前往 Hugging Face、Ollama 等平台下載權重模型。社群也迅速跟進,推出針對 GPU 優化的量化版本。不過也有部分開發者指出,在面對真實世界複雜的程式碼除錯環境時,Gemma 4 仍有優化空間。但整體而言,此次開源釋出無疑為推動數位主權與本地端 AI 應用注入了一劑強心針。 相關報導 AI 支付暗戰:Google 帶 60 家盟友,Stripe 自己建了整條路 Google 的 Gemini 3 Deep Think 大升級:推理能力強壓 Opus 4.6、GPT-5.2,要做「最會科研的 AI」 維基百科25週年宣布:賣內容給微軟、Google、Amazon等AI大廠「授權訓練」〈Google 發布最聰明開放模型 Gemma 4!全面改採 Apache 2.0 授權,效能直逼大型閉源 AI〉這篇文章最早發佈於動區BlockTempo《動區動趨-最具影響力的區塊鏈新聞媒體》。

市場機遇

4實時價格 (4)

$0.010293

$0.010293$0.010293

USD

4 (4) 實時價格圖表

免責聲明: 本網站轉載的文章均來源於公開平台,僅供參考。這些文章不代表 MEXC 的觀點或意見。所有版權歸原作者所有。如果您認為任何轉載文章侵犯了第三方權利,請聯絡 [email protected] 以便將其刪除。MEXC 不對轉載文章的及時性、準確性或完整性作出任何陳述或保證,並且不對基於此類內容所採取的任何行動或決定承擔責任。轉載材料僅供參考,不構成任何商業、金融、法律和/或稅務決策的建議、認可或依據。

您可能也會喜歡

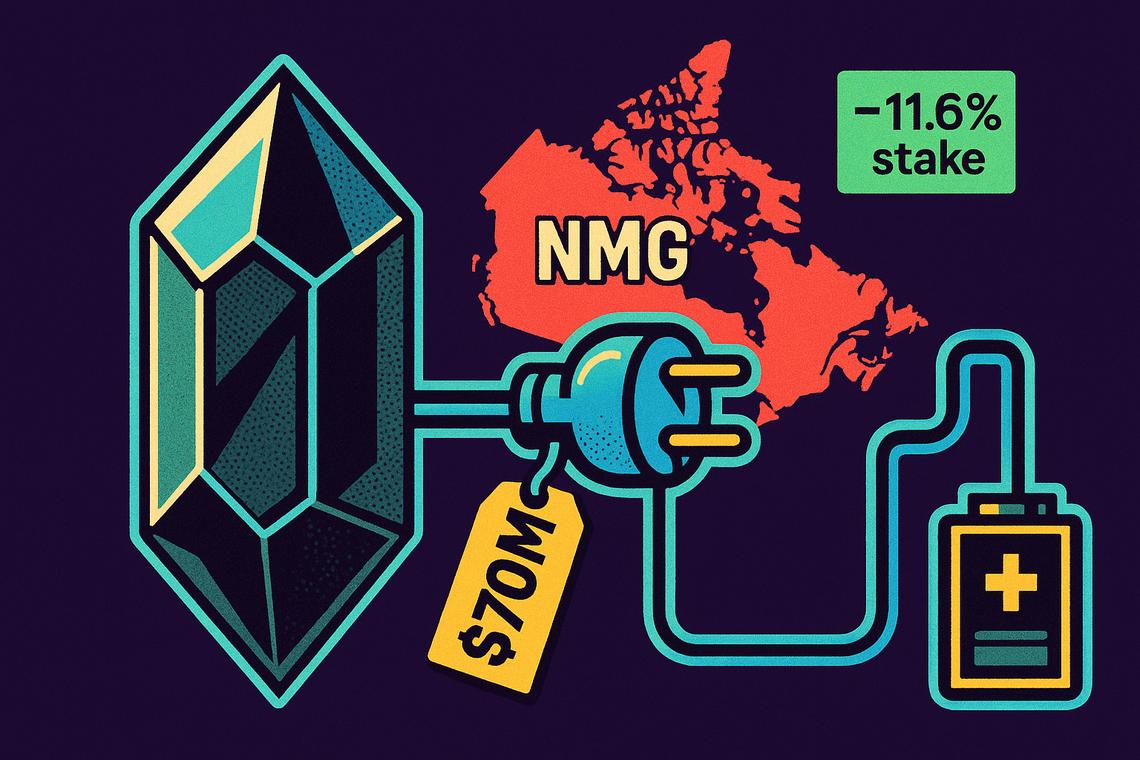

Eni收購Nouveau Monde Graphite約11.6%股權,交易金額達7,000萬美元

埃尼(Eni)對新世界石墨(Nouveau Monde Graphite)的投資現已完成,使這家義大利能源集團在一家加拿大生產商中取得立足點,而該生產商與電池行業最

分享

The Cryptonomist2026/05/18 20:45

Magne.AI與LSP.Finance合作,擴展行動DeFi存取

Magne.AI 宣布與 LSP.Finance 建立戰略合作夥伴關係,此舉旨在加強移動生態系統中去中心化金融的可及性。The

分享

CoinTrust2026/05/18 21:17

Lithosphere擴展AI代理的Web4基礎設施

Lithosphere 正持續擴展其 Web4 基礎設施生態系統,隨著自主人工智能代理在去中心化領域中日益活躍

分享

CoinTrust2026/05/18 21:45