200億美元收編競爭對手 Nvidia建構堅固生態護城河

美國當地時間12月24日,Nvidia被傳以約200億美元現金收購人工智慧(AI)晶片新創公司Groq的核心資產。這不僅創下Nvidia有史以來最大規模的收購紀錄(遠超2019年70億美元收購Mellanox),更意味著這家GPU巨頭在AI推理賽道上完成了一次深遠的策略佈局。

這一消息是由曾領投Groq 7.5億美元融資的美國投資機構Disruptive執行長Alex Davis透露。據悉,Groq並未被整體吞併,其雲業務GroqCloud仍獨立營運;創始人Jonathan Ross等核心高階主管將加入Nvidia,但公司本身由新任執行長Simon Edwards繼續領導;Nvidia獲得的是全部硬體資產與智慧財產權(IP)。

Nvidia共同創辦人暨執行長黃仁勳在內部郵件中也明確表示:「我們並沒有收購Groq這家公司,而是獲得了其低延遲處理器技術的授權,並吸納其頂尖人才。」但毫無疑問,Nvidia以200億美元買下的不僅是一套「晶片設計」,更是一個通往下一代AI基礎設施的關鍵拼圖。

Groq:從TPU之父到LPU革命者

Groq的崛起,源於一位「天才工程師」的遠見。該公司的創始人Jonathan Ross曾是Google張量處理單元(TPU)專案的核心締造者。在Google廣告系統工作的早期,他敏銳察覺到語音辨識、搜索排序等AI任務對算力的巨大渴求。

借助Google著名的「20%自由時間」政策,Ross秘密啟動了一個實驗性專案——這個項目最終演變為改變產業格局的TPU,一度支撐Google全球50%的算力需求。

2016年,Ross離開Alphabet旗下的X實驗室(前身為Google X),創辦Groq,目標直指Nvidia在AI推理領域的統治地位。他帶來了一套顛覆性的架構理念:語言處理單元(Language Processing Unit,LPU)。與傳統GPU依賴外部高頻寬記憶體(HBM)不同,Groq的LPU在單晶片上整合了高達230MB的片上SRAM,提供驚人的80TB/s記憶體頻寬——這一資料遠超GPU方案。

(來源:Groq)

更重要的是,Groq摒棄了CPU/GPU中常見的亂序執行、分支預測等複雜機制,採用「確定性執行」微架構。其核心是張量串流處理器(Tensor Streaming Processor,TSP)與一個功能強大的編譯器協同工作:編譯器精確調度每一項運算和資料流程,實現週期級精準控制。這種「軟體定義硬體」的模式,使得系統在分散式部署中仍能保持極低延遲和高吞吐量,特別適合大模型推理場景。

實測資料顯示,Groq在運作Llama 2、Mixtral等開源模型時,推理速度可達每秒500個tokens,回應速度比主流GPU快數倍,且單位token能耗僅為GPU的三分之一。Groq的目標並非取代訓練晶片,而是抓住一個關鍵趨勢:AI推理需求將很快超過訓練需求。在這個「推理為王」的新時代,Groq試圖成為基礎設施級的高效引擎。

Nvidia策略焦慮:防禦性擴張與生態封閉循環

儘管Nvidia在AI訓練市場佔據絕對主導性(市佔率超80%),但推理市場正呈現百花齊放之勢。Cerebras、SambaNova、Mythic等新創公司紛紛推出專用推理晶片;Google、亞馬遜(Amazon)、微軟(Microsoft)也大力自研TPU、Trainium、Maia等替代方案。

更令Nvidia警惕的是,Groq的LPU在特定場景下已展現出對A100/H100的性能優勢,尤其在低延遲、高確定性任務中。然而,除了Groq之外,Cerebras正加緊與Nvidia競爭 ,力圖打造用於運作生成式 AI 模型的處理器。該公司2024 年底提交了IPO申請,原計劃今年上市,但在10月宣佈完成一輪融資並籌集了超過10億美元後,撤回了其IPO申請。該公司一位發言人表示,Cerebras仍然希望儘快上市。

對於Nvidia而言,與其等待Groq等壯大後成為真正對手,不如提前將其核心技術納入麾下。

值得一提的是,此次交易並非傳統併購,主要獲得全部IP與硬體資產,包括LPU架構、TSP微架構、編譯器技術,同時吸納核心團隊,尤其是Ross這樣的架構大師。不過,該交易排除GroqCloud業務,避免與自身DGX Cloud及合作夥伴(如CoreWeave)產生直接競爭。

Nvidia這種策略,既強化了自身技術累積,又避免了整合風險。黃仁勳在郵件中強調,Groq的低延遲處理器將被整合進「NVIDIA AI工廠」架構,服務於更廣泛的即時AI工作負載——這意味著LPU技術可能以IP模組形式融入下一代Blackwell或Rubin平台,成為CUDA生態的一部分。

據了解,Groq在被接洽前並無出售意願,說明此次交易更多是Nvidia主動發起的「防禦性收購」。

建構更深生態護城河

實際上,除了Nvidia之外,過去幾年,包括Meta、Google和微軟等科技巨頭,均投入鉅資,透過各種類型的授權合約,聘請頂尖的AI人才。

而「人才+ IP」模式正成為Nvidia應對創新挑戰的標準操作。今年9月,Nvidia就進行了一筆類似但規模較小的交易,當時該公司斥資超過9億美元聘請了Enfabrica執行長Rochan Sankar和這家AI硬體新創公司的其他員工,並獲得了該公司的技術授權。

當前,Nvidia加大了對晶片新創公司和更廣泛生態系統的投資。該公司已投資AI和能源基礎設施公司Crusoe、AI模型開發商Cohere,並增加了對CoreWeave的投資。

此外,Nvidia先前還宣佈計畫向OpenAI投資高達1,000億美元,OpenAI承諾部署至少10GW的Nvidia產品。但兩家公司尚未正式宣佈達成協議。同時,Nvidia向英特爾(Intel)投資50億美元的計畫已經得到美國聯邦貿易委員會(FTC)的審批。

Nvidia之所以「大把撒錢」,在於其雄厚的現金儲備。截至2025年10月,Nvidia現金及短期投資累計高達606億美元,遠高於2023年初的133億美元。手握重金的黃仁勳顯然不願坐視所有潛在威脅成長,轉而繼續建構更堅固的生態護城河。

本文原刊登於EE Times China網站

The post 200億美元收編競爭對手 Nvidia建構堅固生態護城河 appeared first on 電子工程專輯.

您可能也會喜歡

21Shares 在 Coinbase Prime 上完成 AAVE 代幣撤資

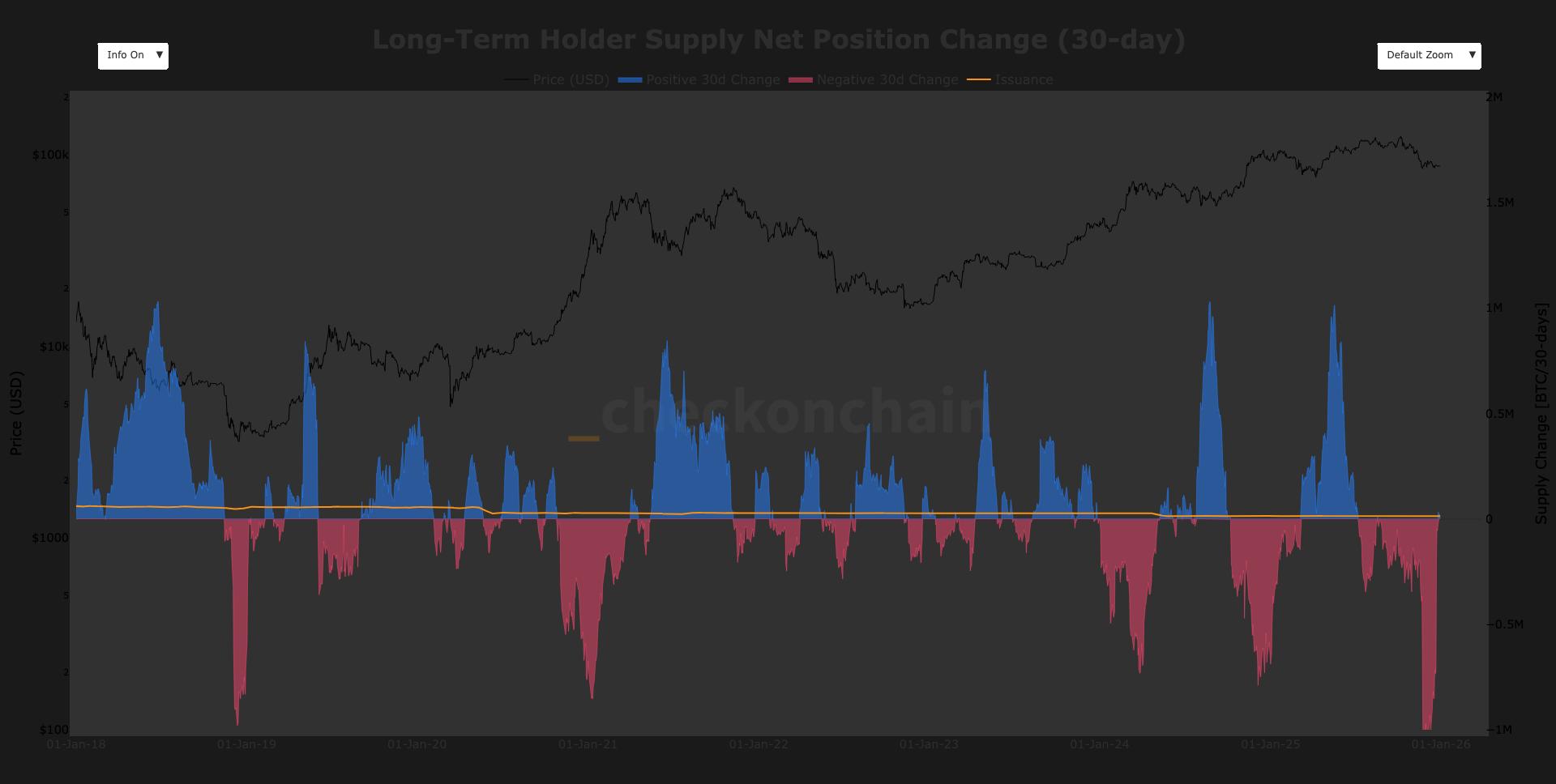

長期持有者轉為淨累積者,緩解比特幣主要阻力