OpenAI ได้เผยแพร่แผนงานนโยบายที่ระบุมาตรการความปลอดภัยใหม่ที่อุตสาหกรรมปัญญาประดิษฐ์ (AI) สามารถดำเนินการเพื่อป้องกันการใช้เทคโนโลยีในการสร้างสื่อการล่วงละเมิดทางเพศเด็ก

"การแสวงหาประโยชน์ทางเพศจากเด็กเป็นหนึ่งในความท้าทายที่เร่งด่วนที่สุดของยุคดิจิทัล" OpenAI กล่าวในการประกาศเมื่อวันที่ 8 เมษายน "AI กำลังเปลี่ยนแปลงอย่างรวดเร็วทั้งวิธีที่อันตรายเหล่านี้เกิดขึ้นในอุตสาหกรรมและวิธีที่สามารถจัดการได้ในวงกว้าง"

ด้วยเหตุนี้ บริษัทได้เปิดเผยแผนงานนโยบายของตน โดยระบุ "เส้นทางที่เป็นจริงไปข้างหน้าสำหรับการเสริมสร้างกรอบการปกป้องเด็กของสหรัฐฯ ในยุคของ AI"

แผนงานนี้สะท้อนและรวมข้อเสนอแนะจากองค์กรชั้นนำและผู้เชี่ยวชาญหลายรายในระบบนิเวศความปลอดภัยของเด็ก รวมถึงศูนย์กลางแห่งชาติสำหรับเด็กที่หายไปและถูกแสวงหาประโยชน์ (NCMEC), Attorney General Alliance—กลุ่มองค์กรไม่แสวงหาผลกำไรของอัยการสูงสุดของรัฐในสหรัฐอเมริกา—และ Thorn องค์กรไม่แสวงหาผลกำไรที่อุทิศตนเพื่อปกป้องเด็กจากการล่วงละเมิดทางเพศ ตามที่ยักษ์ใหญ่ด้าน AI กล่าว

"ไม่มีการแทรกแซงเพียงอย่างเดียวที่สามารถจัดการกับความท้าทายนี้ได้" OpenAI กล่าว "กรอบงานนี้นำเอากฎหมาย การปฏิบัติงาน และแนวทางทางเทคนิคมารวมกันเพื่อระบุความเสี่ยงได้ดีขึ้น เร่งการตอบสนอง และสนับสนุนความรับผิดชอบ ขณะเดียวกันก็ทำให้แน่ใจว่าหน่วยงานบังคับใช้ยังคงมีความเข้มแข็งเมื่อเทคโนโลยีพัฒนาไป"

การเคลื่อนไหวครั้งนี้เกิดขึ้นในขณะที่ความกังวลได้เพิ่มสูงขึ้นเกี่ยวกับการใช้เครื่องมือ AI ในทางที่ผิด โดยเฉพาะฟังก์ชันการสร้างภาพ เพื่อผลิตภาพที่ชัดเจนของผู้หญิงและเด็ก รวมถึงคนดังและบุคคลสาธารณะ

ก่อนหน้านี้ในเดือนมกราคม หน่วยงานกำกับดูแลการสื่อสารของสหราชอาณาจักร Ofcom ถูกบังคับให้ติดต่อ X และ xAI อย่างเร่งด่วน "เพื่อเข้าใจว่าพวกเขาได้ดำเนินการขั้นตอนใดเพื่อปฏิบัติตามหน้าที่ทางกฎหมายในการปกป้องผู้ใช้ในสหราชอาณาจักร" หลังจากมีรายงานว่าแชทบอต AI ของ Elon Musk ชื่อ Grok ถูกใช้ในการสร้างและเผยแพร่ภาพที่ชัดเจนของเด็กและผู้หญิงที่เสื้อผ้าถูกลบออกทางดิจิทัล

ความกังวลที่คล้ายกันถูกแสดงออกในสหภาพยุโรป โดยหน่วยงานคุ้มครองข้อมูลของอิตาลีเตือนผู้ใช้และผู้ให้บริการเครื่องมือ AI เกี่ยวกับความเสี่ยงต่อ "สิทธิและเสรีภาพขั้นพื้นฐาน" ที่เกิดจาก deepfakes ของ AI

เพื่อจัดการกับความกังวลดังกล่าว OpenAI กล่าวว่ามีลำดับความสำคัญหลักสามประการ: การปรับปรุงกฎหมายเพื่อต่อสู้กับสื่อการล่วงละเมิดทางเพศเด็กที่สร้างและปรับเปลี่ยนโดย AI, การปรับปรุงการรายงานและการประสานงานของผู้ให้บริการเพื่อสนับสนุนการสืบสวนที่มีประสิทธิภาพมากขึ้น และการสร้างมาตรการความปลอดภัยตั้งแต่การออกแบบโดยตรงในระบบ AI เพื่อป้องกันและตรวจจับการใช้ในทางที่ผิด

"รวมกันแล้ว ขั้นตอนเหล่านี้ทำให้อุตสาหกรรมสามารถจัดการกับความปลอดภัยของเด็กได้เร็วขึ้นและมีประสิทธิภาพมากขึ้น" บริษัทกล่าวในแถลงการณ์เมื่อวันที่ 8 เมษายน "โดยการขัดจังหวะความพยายามในการแสวงหาประโยชน์เร็วขึ้น ปรับปรุงคุณภาพของสัญญาณที่ส่งไปยังหน่วยงานบังคับใช้กฎหมาย และเสริมสร้างความรับผิดชอบทั่วทั้งระบบนิเวศ กรอบงานนี้มุ่งหวังที่จะป้องกันอันตรายก่อนที่จะเกิดขึ้นและช่วยให้แน่ใจว่ามีการปกป้องเด็กได้เร็วขึ้นเมื่อความเสี่ยงเกิดขึ้น"

OpenAI กล่าวว่ามุ่งมั่นที่จะเสริมสร้างมาตรการป้องกันอย่างต่อเนื่องเพื่อป้องกันการใช้ระบบในทางที่ผิด รวมถึงทำงานอย่างใกล้ชิดกับพันธมิตรเช่น NCMEC และหน่วยงานบังคับใช้กฎหมายเพื่อปรับปรุงการตรวจจับและการรายงาน

ในแถลงการณ์ร่วมเกี่ยวกับแผนงานความปลอดภัยของเด็ก อัยการสูงสุดของรัฐ Jeff Jackson (แห่งนอร์ทแคโรไลนา) และ Derek Brown (แห่งยูทาห์) ประธานร่วมของคณะทำงาน AI ของ Attorney General Alliance กล่าวว่าพวกเขา "ยินดีต้อนรับแผนงานนี้ในฐานะก้าวที่มีความหมายต่อการจัดแนวแนวปฏิบัติด้านความปลอดภัยของเด็กของภาคเทคโนโลยีกับความเป็นจริงในการบังคับใช้กฎหมายที่สำนักงานของเราเผชิญทุกวัน"

ทั้งคู่เน้นเป็นพิเศษถึงการรับรู้ของกรอบงานว่าการป้องกันปัญญาประดิษฐ์เชิงสร้างสรรค์ (GenAI) ที่มีประสิทธิภาพต้องการการป้องกันแบบหลายชั้น—ไม่ใช่การควบคุมทางเทคนิคเพียงอย่างเดียว แต่เป็นการผสมผสานของการตรวจจับ กลไกการปฏิเสธ การกำกับดูแลของมนุษย์ และการปรับตัวอย่างต่อเนื่องต่อแนวโน้มการใช้ในทางที่ผิดที่เกิดขึ้นใหม่

"สิ่งนี้สะท้อนถึงสิ่งที่เราเห็นในทางปฏิบัติ: ภัยคุกคามพัฒนาอย่างต่อเนื่อง และวิธีแก้ปัญหาแบบคงที่ไม่เพียงพอ" อัยการสูงสุดของรัฐกล่าว

การประกาศของ OpenAI ยังได้รับการต้อนรับจาก Michelle DeLaune ประธานและ CEO ของ NCMEC ซึ่งเตือนว่า GenAI กำลัง "เร่งอาชญากรรมการแสวงหาประโยชน์ทางเพศเด็กออนไลน์ในรูปแบบที่น่าวิตกกังวลอย่างยิ่ง — ลดอุปสรรค เพิ่มขนาด และเปิดใช้งานรูปแบบอันตรายใหม่ๆ"

DeLaune กล่าวเสริมว่าเธอ "รู้สึกได้รับกำลังใจที่เห็นบริษัทเช่น OpenAI ไตร่ตรองถึงวิธีที่เครื่องมือเหล่านี้สามารถออกแบบได้อย่างมีความรับผิดชอบมากขึ้น โดยมีมาตรการป้องกันที่สร้างขึ้นตั้งแต่เริ่มต้น"

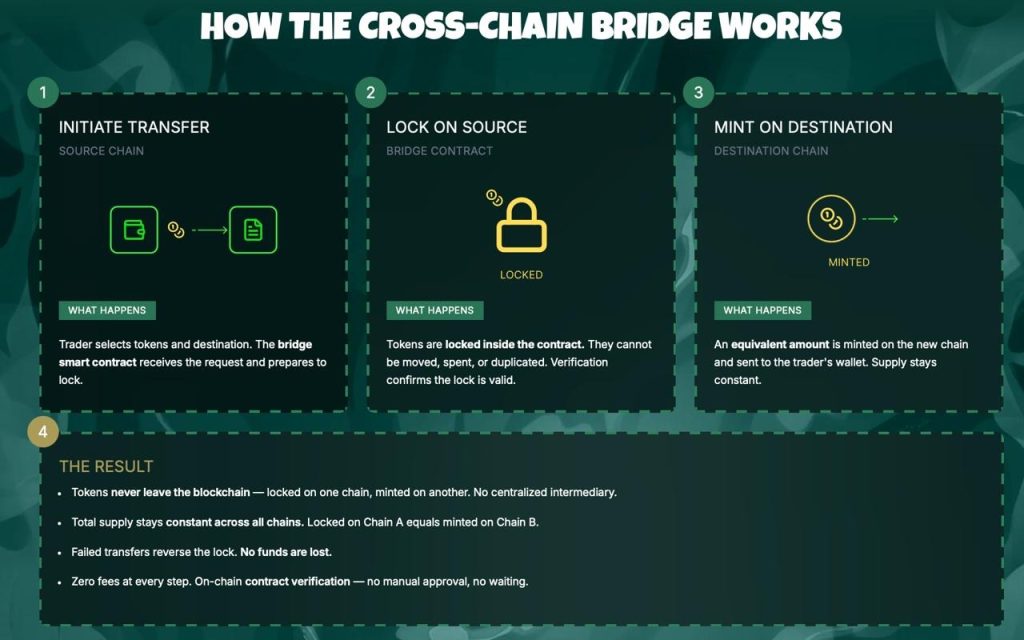

เพื่อให้ปัญญาประดิษฐ์ (AI) ทำงานได้อย่างถูกต้องภายใต้กฎหมายและเจริญรุ่งเรืองเมื่อเผชิญกับความท้าทายที่เพิ่มมากขึ้น จำเป็นต้องผสานรวมระบบบล็อกเชนองค์กรที่ทำให้มั่นใจถึงคุณภาพและความเป็นเจ้าของข้อมูลที่นำเข้า—ทำให้สามารถรักษาข้อมูลให้ปลอดภัยในขณะเดียวกันก็รับประกันความไม่เปลี่ยนแปลงของข้อมูล ตรวจสอบความคุ้มครองของ CoinGeek เกี่ยวกับเทคโนโลยีเกิดใหม่นี้เพื่อเรียนรู้เพิ่มเติมว่าทำไมบล็อกเชนองค์กรจะเป็นแกนหลักของ AI

ดู: สาธิตศักยภาพของการผสานรวมบล็อกเชนกับ AI

แหล่งที่มา: https://coingeek.com/openai-blueprint-targets-ai-enabled-child-exploitation/