Militer AS gunakan Anthropic untuk serangan Iran meski dilarang Trump: WSJ

Militer AS dilaporkan mengandalkan Claude AI milik Anthropic selama serangan udara besar di Iran, perkembangan yang muncul hanya beberapa jam setelah Presiden Donald Trump memerintahkan lembaga federal untuk menghentikan penggunaan model tersebut. Komando di wilayah tersebut, termasuk CENTCOM, dilaporkan menggunakan Claude untuk mendukung analisis intelijen, verifikasi target, dan simulasi medan perang. Kejadian ini menyoroti betapa dalamnya alat AI telah diintegrasikan ke dalam operasi pertahanan meskipun pembuat kebijakan mendorong untuk memutuskan hubungan dengan vendor tertentu. Kejadian ini menggarisbawahi ketegangan antara arahan eksekutif dan otomasi di lapangan yang dapat mempengaruhi pengadaan dan manajemen risiko di seluruh program pertahanan.

Poin-poin penting

- <li Claude AI dilaporkan digunakan untuk analisis intelijen, verifikasi target, dan simulasi medan perang sehubungan dengan serangan udara besar, beberapa jam setelah arahan Gedung Putih untuk menghentikan penggunaan sistem tersebut.

-

<li Anthropic sebelumnya telah mengamankan kontrak Pentagon multitahun senilai hingga $200 juta, dengan kolaborasi melibatkan Palantir dan Amazon Web Services untuk memungkinkan alur kerja terklasifikasi untuk Claude.

-

<li Pemerintahan Trump menginstruksikan lembaga-lembaga untuk berhenti bekerja dengan Anthropic dan mengarahkan Departemen Pertahanan untuk memperlakukan perusahaan tersebut sebagai risiko keamanan potensial setelah pembicaraan kontrak gagal terkait penggunaan militer tanpa batas.

-

<li Pentagon mulai mengidentifikasi penyedia pengganti dan berupaya untuk menerapkan model AI lain di jaringan terklasifikasi, termasuk kolaborasi dengan OpenAI untuk penerapan tersebut.

-

<li CEO Anthropic Dario Amodei secara terbuka menolak larangan tersebut, dengan alasan bahwa aplikasi militer tertentu melintasi batas etika dan harus tetap di bawah pengawasan manusia daripada pengawasan massal otomatis atau persenjataan otonom.

Sentimen: Netral

Konteks pasar: Kejadian ini berada di persimpangan pengadaan pertahanan, etika AI, dan manajemen risiko keamanan nasional saat lembaga-lembaga menilai kembali ketergantungan vendor dan klasifikasi alat AI untuk operasi sensitif.

Mengapa ini penting

Insiden ini menawarkan pandangan langka tentang bagaimana model AI komersial diintegrasikan ke dalam alur kerja militer berisiko tinggi. Claude, yang awalnya dirancang untuk tugas kognitif luas, dilaporkan mendukung analisis intelijen dan pemodelan skenario medan perang, menunjukkan tingkat kepercayaan operasional yang meluas melampaui lingkungan laboratorium ke misi dunia nyata. Ini menimbulkan pertanyaan penting tentang keandalan, audit, dan kontrol AI dalam perencanaan pertempuran, terutama ketika sinyal kebijakan pemerintah berubah dengan cepat terkait penggunaan vendor.

Di tingkat kebijakan, gesekan antara hubungan kontrak dan arahan presiden menyoroti perdebatan yang lebih luas tentang bagaimana vendor AI harus diperlakukan di lingkungan aman. Penolakan Anthropic untuk memberikan penggunaan militer tanpa batas sejalan dengan batasan etika yang dinyatakan, menandakan bahwa penyedia sektor swasta mungkin semakin menolak konfigurasi yang mereka anggap bermasalah secara etis. Respons Pentagon—beralih ke pemasok alternatif untuk beban kerja terklasifikasi—menggambarkan bagaimana departemen pertahanan dapat mendiversifikasi ekosistem AI untuk mengurangi paparan risiko, sambil mempertahankan kemampuan dalam operasi sensitif.

Ketegangan ini juga menyentuh dinamika kompetitif pasar AI-as-a-service. Dengan OpenAI dilaporkan masuk untuk menyediakan model untuk jaringan terklasifikasi, sektor ini kemungkinan akan menyaksikan eksperimen berkelanjutan dan renegosiasi persyaratan seputar klasifikasi keamanan, tata kelola data, dan risiko rantai pasokan. Situasi ini menggarisbawahi kebutuhan akan kerangka tata kelola yang ketat yang dapat beradaptasi dengan perubahan teknologi yang cepat tanpa mengorbankan keamanan operasional atau standar etika.

Yang perlu diperhatikan selanjutnya

- Pembaruan peraturan dan kebijakan dari Departemen Pertahanan dan Gedung Putih mengenai penggunaan vendor AI dan klasifikasi keamanan.

- Pengadaan atau kemitraan baru yang memperluas kemampuan AI untuk misi terklasifikasi, termasuk perjanjian potensial dengan penyedia alternatif untuk menggantikan atau melengkapi penawaran Anthropic.

- Pernyataan publik dari Anthropic dan OpenAI tentang sifat penerapan di jaringan yang diamankan dan batasan atau pagar pengaman baru.

- Detail lebih lanjut tentang hasil negosiasi penggunaan tanpa batas sebelumnya dan bagaimana hal itu akan membentuk kontrak pertahanan masa depan dengan vendor AI.

Sumber & verifikasi

- Laporan tentang penggunaan Claude dalam operasi Timur Tengah dan perintah penghentian pemerintahan, termasuk bukti yang didiskusikan dengan sumber yang familiar dengan masalah ini.

- Latar belakang kontrak Pentagon Anthropic, termasuk pengaturan multitahun senilai hingga $200 juta dan kemitraan dengan Palantir dan AWS untuk alur kerja terklasifikasi.

- Pernyataan dari kepemimpinan Anthropic dan komentar publik tentang penggunaan militer dan batasan etika, termasuk wawancara dan tanggapan resmi terhadap tindakan regulasi.

- Penerapan OpenAI di jaringan terklasifikasi dan diskusi terkait, termasuk wacana publik seputar kesepakatan dengan militer AS dan liputan terkait.

- Diskusi publik dan referensi media sosial yang terhubung dengan pengaturan OpenAI dengan militer, seperti posting yang mendokumentasikan reaksi industri.

Claude milik Anthropic dalam bidikan: AI, etika dan kebijakan bertabrakan dalam operasi pertahanan

Pejabat menggambarkan Claude sebagai memainkan peran dalam analisis intelijen dan perencanaan operasional selama serangan udara besar di Iran, klaim yang menggambarkan seberapa dekat alat AI telah bergerak ke pengambilan keputusan medan perang. Sementara pemerintahan Trump berupaya memutuskan hubungan dengan Anthropic, penggunaan operasional Claude dilaporkan terus berlanjut di komando tertentu, menggarisbawahi ketidaksesuaian antara pernyataan kebijakan dan alur kerja pertahanan sehari-hari. Kenyataan praktisnya adalah bahwa analisis yang didorong AI, simulasi, dan penilaian risiko dapat masuk ke dalam perencanaan misi bahkan saat lembaga menilai kembali risiko vendor dan persyaratan kepatuhan di seluruh departemen.

Keterlibatan Pentagon sebelumnya dengan Anthropic sangat substansial: kontrak multitahun senilai hingga $200 juta dan jaringan kemitraan, termasuk Palantir dan Amazon Web Services, yang memungkinkan penggunaan Claude dalam penanganan informasi terklasifikasi dan pemrosesan intelijen. Pengaturan ini menyoroti strategi yang lebih luas: diversifikasi kemampuan AI di seluruh ekosistem tepercaya untuk memastikan ketahanan dalam pengaturan sensitif. Namun ketika arah kebijakan berubah, pemerintahan berupaya membingkai ulang hubungan vendor, menandakan rekalibrasi berbasis risiko daripada mundur total dari operasi pertahanan yang diaktifkan AI.

Di balik layar, ketegangan antara kebijakan publik dan etika sektor swasta muncul ke permukaan. Menteri Pertahanan Pete Hegseth dilaporkan menekan Anthropic untuk mengizinkan penggunaan militer tanpa batas dari modelnya, permintaan yang ditolak oleh kepemimpinan Anthropic sebagai melintasi garis etika yang tidak akan dilintasi perusahaan. Sikap perusahaan berpusat pada keyakinan bahwa penggunaan tertentu—pengawasan domestik massal dan senjata sepenuhnya otonom—menimbulkan kekhawatiran etika dan hukum yang mendalam, dan bahwa pengawasan manusia yang bermakna harus bertahan dalam transisi dari konsep ke eksekusi. Posisi ini sejalan dengan perdebatan berkelanjutan tentang bagaimana menyeimbangkan adopsi AI yang cepat dengan perlindungan terhadap penyalahgunaan dan konsekuensi yang tidak diinginkan.

Di pihaknya, Pentagon tidak tinggal diam. Menghadapi kesenjangan pemasok potensial, Pentagon mulai menyiapkan pengganti dan dilaporkan mencapai kesepakatan dengan OpenAI untuk menerapkan model di jaringan terklasifikasi. Pergeseran ini menggarisbawahi langkah strategis yang lebih luas untuk memastikan kontinuitas kemampuan, bahkan saat vendor mengevaluasi kembali persyaratan mereka untuk penerapan sensitif. Kontras antara batasan etika Anthropic dan kebutuhan operasional departemen mengungkapkan ketegangan kebijakan yang lebih luas: bagaimana memanfaatkan teknologi transformatif secara bertanggung jawab sambil mempertahankan imperatif keamanan nasional.

Pengamat industri juga mencatat efek ekosistem dari transisi semacam itu. Pasar AI berkembang menuju konfigurasi modular yang lebih aman yang dapat ditukar atau ditingkatkan saat kebijakan dan penilaian risiko berubah. Pengaturan OpenAI, khususnya, menandakan nafsu berkelanjutan untuk mengintegrasikan model terkemuka ke dalam jaringan pertahanan, meskipun di bawah tata kelola dan pengawasan yang ketat. Sementara lintasan ini menjanjikan kemampuan yang ditingkatkan untuk analis dan perencana militer, ini juga meningkatkan pengawasan seputar penanganan data, interpretabilitas model, dan risiko terlalu bergantung pada sistem otomatis untuk keputusan kritis.

CEO Anthropic, Dario Amodei, telah berargumen bahwa meskipun AI dapat meningkatkan penilaian manusia, AI tidak dapat menggantikannya dalam keputusan pertahanan inti. Dalam pernyataan publik, dia menegaskan kembali komitmen perusahaan terhadap batasan etika dan mempertahankan kontrol manusia di saat-saat penting. Ketegangan antara mempertahankan akses ke alat mutakhir dan menjunjung tinggi standar etika kemungkinan akan membentuk negosiasi masa depan dengan lembaga federal, terutama saat pembuat undang-undang dan regulator meneliti peran AI dalam konteks sipil dan keamanan nasional.

Saat lanskap berkembang, komunitas kripto dan teknologi yang lebih luas akan mengamati bagaimana dinamika kebijakan dan pengadaan ini mempengaruhi pengembangan dan penerapan sistem AI canggih di lingkungan berisiko tinggi. Kejadian ini berfungsi sebagai studi kasus dalam menyeimbangkan kemajuan teknologi yang cepat dengan tata kelola, pengawasan, dan pertanyaan abadi tentang di mana tanggung jawab manusia berakhir dan pengambilan keputusan otomatis dimulai.

Artikel ini awalnya dipublikasikan sebagai US military used Anthropic for Iran strike despite Trump's ban: WSJ di Crypto Breaking News – sumber terpercaya Anda untuk berita kripto, berita Bitcoin, dan pembaruan blockchain.

Anda Mungkin Juga Menyukai

Harga Hyperliquid (HYPE): Tertinggi Sepanjang Masa dan ETF Ketiga Segera Hadir — Inilah yang Mendorongnya

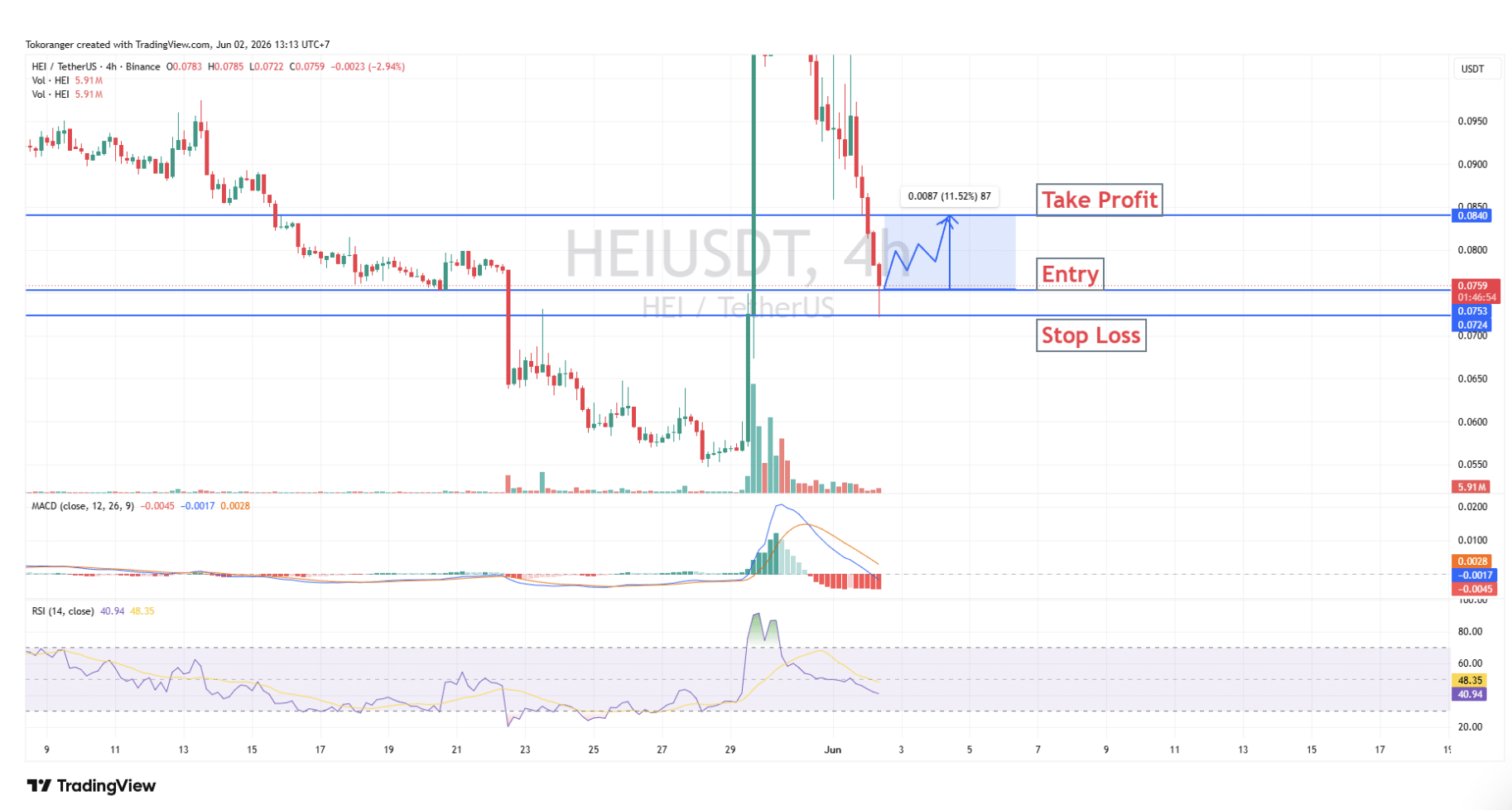

Sinyal Kripto 2 Juni 2026: Analisis Teknikal dan Proyeksi Pasar