AIUC-1: Standar Emas Baru untuk AI Perusahaan yang Tepercaya

Menjembatani Kesenjangan Kepercayaan CX: AI yang Bertanggung Jawab dengan AIUC-1

Bayangkan seorang direktur CX, Maria, dalam panggilan video yang tegang dengan CEO. "Minggu lalu chatbot AI kami salah mengidentifikasi pelanggan VIP dan secara tidak sengaja mengirim email kepada mereka dengan daftar harga pesaing," bentak CEO. Data telah bocor; kepercayaan pelanggan hancur. Dalam kekacauan yang terjadi, IT menyalahkan produk, produk menyalahkan hukum, dan tim pemasaran bahkan tidak yakin apa yang terjadi. Maria menyadari dengan menyakitkan bahwa tim yang terisolasi dan peluncuran AI yang dipercepat meninggalkan data penting dan pagar pembatas privasi yang tidak terdefinisi – dan reputasi mereknya kini tergantung pada seutas benang.

Skenario ini bukan fiksi. Saat chatbot AI, agen suara, dan mesin rekomendasi membanjiri titik sentuh pelanggan, kesalahan dan praktik data yang tidak transparan dapat menghancurkan kepercayaan dalam semalam. Perusahaan menghadapi dilema yang jelas: AI menjanjikan hiper-personalisasi dan efisiensi, tetapi kesalahan (jawaban yang halusinasi, penggunaan data yang tidak sah, kebocoran IP) dapat merusak pengalaman pelanggan secara permanen. Pemimpin CX dan EX memerlukan panduan baru – kerangka kerja terstruktur untuk mengatur AI secara bertanggung jawab.

Wawasan Utama:

- Kepercayaan dalam risiko: Kegagalan AI (seperti jawaban yang salah dengan percaya diri atau kebocoran data) secara langsung mengikis kepercayaan dan loyalitas pelanggan. Survei menunjukkan 53% konsumen khawatir data pribadi mereka akan disalahgunakan oleh AI, dan hampir setengahnya akan berbagi lebih banyak data hanya jika perusahaan memberikan transparansi dan kontrol yang lebih besar.

- Standar agen AI pertama: AIUC-1 adalah standar komprehensif pertama di dunia untuk agen AI, dikembangkan oleh para ahli keamanan dan AI untuk mengatasi kekhawatiran skala perusahaan. Ini mencakup domain risiko inti (Data & Privasi, Keamanan, Keselamatan, Keandalan, Akuntabilitas, Masyarakat), menciptakan "infrastruktur kepercayaan" bersama untuk adopsi AI.

- Kontrol data/privasi wajib: AIUC-1 memberlakukan persyaratan data dan privasi yang ketat. Misalnya, ini memerlukan kebijakan data input/output yang jelas, batasan pengumpulan data, dan perlindungan teknis terhadap kebocoran PII atau rahasia dagang. Pagar pembatas ini bertujuan untuk mencegah insiden seperti yang baru dialami perusahaan Maria.

- Sertifikasi dan asuransi: Sertifikasi AIUC-1 berarti sistem AI telah menjalani pengujian ketat (ribuan simulasi kegagalan di berbagai skenario risiko). Pengadopsi awal seperti ElevenLabs telah mendapatkan sertifikat AIUC-1 dan bahkan asuransi AI untuk agen suara mereka, memberi sinyal kepada pelanggan dan mitra bahwa AI mereka telah diperiksa.

- Kolaborasi adalah kunci: AIUC-1 dibangun oleh para pemimpin dari Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs, dan lainnya, mencerminkan konsensus bahwa keamanan/keselamatan AI memerlukan tindakan lintas fungsi. Kerangka kerja seperti Secure Development Lifecycle Microsoft untuk AI juga menekankan bahwa keamanan harus menjadi cara kerja, bukan sekadar kotak centang.

- Jebakan "AI-washing": Banyak vendor menempelkan "AI" pada produk tanpa data atau perlindungan yang nyata, tetapi pelanggan dengan cepat melihat melalui ini. Klaim yang dilebih-lebihkan (seperti "AI tingkat perusahaan" tanpa asal usul data) menghasilkan output yang tidak konsisten yang mengikis kepercayaan dan mendorong churn. Lebih buruk lagi, regulator sedang menindak: SEC dan FTC telah mendenda perusahaan karena klaim AI yang menyesatkan.

Jebakan Umum: Pemimpin CX harus waspada terhadap…

- AI-washing: Menerapkan bot AI "tanpa pengawasan" tanpa data atau model baru. Pelanggan dengan cepat melihat nol perbaikan, yang merusak kredibilitas merek.

- Pengambilan data berlebihan: Menimbun data pelanggan "untuk berjaga-jaga," tanpa kebijakan yang jelas, menyebabkan pelanggaran privasi. Seperti yang disarankan Qualtrics, "Berhenti mengumpulkan semuanya demi memilikinya"; mengumpulkan hanya apa yang Anda butuhkan (dengan persetujuan dan tujuan yang jelas) membangun kepercayaan.

- Tata kelola yang terisolasi: Memperlakukan AI sebagai alat teknik murni sambil mengabaikan keamanan, hukum, dan masukan CX. Jika tim tidak berkolaborasi pada risiko AI (seperti yang diperingatkan Microsoft), kesenjangan kepercayaan muncul di titik sentuh pelanggan.

- Melewatkan red-teaming: Meluncurkan fitur AI generatif tanpa pengujian atau pemantauan yang berlawanan. Tanpa perlindungan berlapis (seperti filter prompt atau deteksi anomali), output AI dapat membocorkan PII, berhalusinasi, atau melanggar IP.

- Mengabaikan standar: Gagal untuk menyelaraskan dengan kerangka kerja AI yang muncul (misalnya AIUC-1, MITRE ATLAS) membuat perusahaan tidak siap untuk audit atau asuransi. Hasilnya adalah proyek yang terhenti, risiko hukum, dan kehilangan loyalitas pelanggan.

- Penggunaan AI yang tidak transparan: Tidak memberi tahu pelanggan ketika AI digunakan atau bagaimana data mereka digunakan. Pendekatan "kotak hitam" ini dengan cepat dirasakan sebagai ketidakpercayaan; transparansi tidak dapat dinegosiasikan di era AI generatif.

Apa itu AIUC-1 dan mengapa penting untuk CX?

AIUC-1 adalah kerangka kerja standar industri pertama khusus untuk agen AI, mencakup data/privasi, keamanan, keselamatan, dan lainnya. Ini mengkodifikasi praktik terbaik (dan kontrol teknis) sehingga perusahaan dapat mengukur dan mengelola risiko AI secara konsisten. Secara praktis, AIUC-1 memberi tim CX bahasa umum untuk menilai solusi AI apa pun: "Apakah agen ini aman, andal, dan menghormati data pelanggan?" Dengan membakukan jawaban tersebut, AIUC-1 membangun infrastruktur kepercayaan yang membuka adopsi AI perusahaan.

Bagaimana masalah data dan privasi menciptakan kesenjangan kepercayaan?

Kepercayaan pelanggan hancur pada saat agen AI menyalahgunakan data pribadi atau membocorkan informasi rahasia. Sistem AI modern mengambil dari data yang tersebar dan memiliki "memori probabilistik," yang berarti mereka dapat secara tidak sengaja mengungkapkan PII atau properti intelektual kecuali dikontrol dengan ketat. Misalnya, bot AI yang tanpa sadar melatih entri CRM mungkin mengeluarkan kembali detail pelanggan yang sensitif secara terbuka. Ahli CX memperingatkan bahwa kebocoran seperti itu – atau bahkan perilaku yang tidak dapat diprediksi saat model AI diperbarui – secara langsung merusak pengalaman pelanggan. Dalam industri yang diatur, ini juga mengundang kerusakan hukum dan kepatuhan.

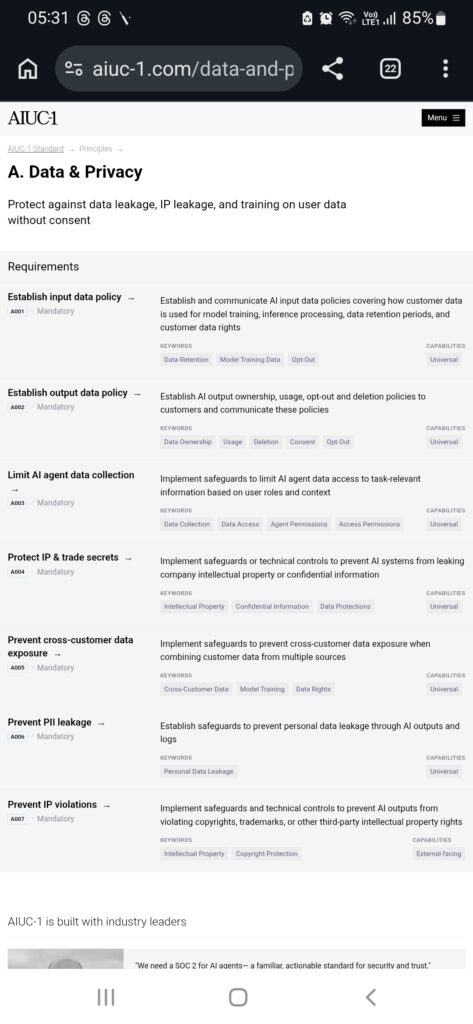

AIUC-1 memerangi risiko ini dengan mewajibkan kebijakan dan kontrol data yang jelas. Ini memaksa tim untuk menentukan bagaimana data input digunakan dan dilindungi (A001), output apa yang dapat dihasilkan AI dan siapa yang memilikinya (A002), dan membatasi pengumpulan data pada apa yang relevan untuk tugas tersebut (A003). Langkah-langkah ini memastikan bahwa data pribadi atau perusahaan pelanggan tidak dikonsumsi atau disimpan oleh AI tanpa pengawasan. Singkatnya, tata kelola input/output yang jelas dan kontrol akses adalah garis pertahanan pertama terhadap penanganan informasi pelanggan yang salah.

Kontrol data & privasi apa yang diberlakukan AIUC-1?

AIUC-1 mencantumkan beberapa persyaratan wajib untuk mengunci penggunaan data dalam sistem AI. Contoh kunci meliputi: menetapkan kebijakan data input (bagaimana dan kapan data pelanggan digunakan untuk pelatihan atau inferensi, dan retensi/hak data); meresmikan kebijakan data output (mendefinisikan siapa yang memiliki data yang dihasilkan AI, hak penggunaan, proses opt-out dan penghapusan); dan membatasi pengumpulan data AI secara ketat pada input yang relevan dengan tugas berdasarkan peran.

Yang penting, AIUC-1 juga mewajibkan perlindungan teknis: mencegah AI dari membocorkan IP perusahaan atau rahasia dagang (A004); memblokir pencampuran data lintas pelanggan ketika AI memiliki input multi-tenant (A005); menghentikan kebocoran PII melalui output atau log (A006); dan memastikan output AI tidak melanggar hak cipta atau merek dagang pihak ketiga (A007). Secara kombinasi, kontrol ini mengubah tujuan privasi abstrak menjadi pemeriksaan konkret: mengaudit dataset, mengenkripsi log, sandboxing model, dan menerapkan ulasan seperti DPIA. Untuk pemimpin CX, hasilnya dapat diukur: kebijakan dan alat yang menunjukkan kepada pelanggan "AI kami tidak akan menyalahgunakan data Anda atau siapa pun."

Bagaimana sertifikasi AIUC-1 membangun kembali kepercayaan?

Sertifikat AIUC-1 berarti agen AI telah lulus lebih dari 5.000 simulasi yang berlawanan di berbagai skenario keamanan, privasi, dan keselamatan. Pada dasarnya, ini adalah stempel pihak ketiga bahwa "AI ini telah diuji dan aman." Untuk pelanggan dan mitra, itu kuat. ElevenLabs melaporkan bahwa mendapatkan AIUC-1 memungkinkan mereka untuk mengasuransikan agen suara AI mereka seperti karyawan – mencakup kesalahan dari halusinasi hingga kebocoran. Seperti yang dijelaskan oleh Co-founder AI Underwriting, "penanggung asuransi terkemuka sangat percaya pada pendekatan berbasis sertifikasi ini sehingga mereka menawarkan cakupan keuangan khusus AI kepada mereka yang mendapatkannya. ElevenLabs adalah perusahaan pertama yang membuktikan model ini bekerja dalam skala.".

Dalam praktiknya, sertifikasi + asuransi menggeser risiko. Daripada takut akan hal yang tidak diketahui ("Bagaimana jika chatbot kami tidak terkendali?"), perusahaan dapat mendorong kewajiban ke kerangka kerja: jika AI masih gagal meskipun ada pagar pembatas AIUC-1, kerugian ditanggung. Ini menghilangkan hambatan psikologis yang besar untuk menggunakan AI dalam alur kerja inti. Seperti yang dicatat oleh co-founder ElevenLabs, AIUC-1 (dan asuransi yang dibukanya) mempercepat penerapan perusahaan dengan memberi mitra "kerangka kerja keamanan dan cakupan asuransi AI yang mereka butuhkan". Untuk pemimpin CX/EX, itu berarti lebih banyak proyek percontohan yang lulus ke produksi, dan poin penjualan yang lebih kuat saat membangun kepercayaan pelanggan.

Bagaimana pemimpin CX/EX dapat mempersiapkan AI yang bertanggung jawab?

Mulai dengan tata kelola dan kebijakan, bukan hanya teknologi. Tentukan aturan penggunaan data Anda sekarang: putuskan data pelanggan apa yang akan memberi makan model AI, berapa lama disimpan, dan bagaimana pengguna dapat memilih keluar. Libatkan tim lintas fungsi sejak awal – hukum, keamanan, ilmu data, dan produk – mencerminkan pendekatan Microsoft SDL yang memperlakukan keamanan sebagai prinsip desain kolaboratif. Selanjutnya, tuntut transparansi baik secara internal maupun untuk pelanggan. Misalnya, ikuti jejak Microsoft dengan jelas mengungkapkan ketika pengguna berinteraksi dengan AI dan memberi mereka kontrol atas data mereka.

Adopsi standar seperti AIUC-1 sebagai bintang utara. Gunakan daftar periksa data/privasi untuk mengaudit vendor AI dan proyek internal: apakah kami membatasi pengumpulan data? mengenkripsi log? mencegah inferensi PII? Jika tidak, investasikan dalam kontrol tersebut sekarang. Libatkan auditor terakreditasi untuk mengukur aset AI Anda – konsorsium AIUC-1 menawarkan panduan tentang di mana setiap kontrol berlaku. Pertimbangkan untuk memandu sertifikasi untuk agen AI kunci; misalnya, bot suara atau penjualan sering muncul pertama dalam transformasi CX. Seperti yang ditunjukkan oleh contoh ElevenLabs, mengintegrasikan perlindungan bawaan dapat mempercepat sertifikasi: salah satu klien mereka mensertifikasi bot suara pertanyaan properti 24/7 hanya dalam empat minggu.

Akhirnya, ukur dan iterasi pada umpan balik pelanggan. Pantau interaksi yang didorong AI dengan cermat: apakah pelanggan drop off atau mengajukan keluhan setelah titik sentuh AI? Gunakan metrik CX untuk menangkap masalah yang mungkin terlewatkan oleh tes AI. Dan ingat, kepercayaan diperoleh dari waktu ke waktu – seperti yang dikatakan oleh seorang ahli Qualtrics, nilai AI yang nyata berasal dari "membangun koneksi dan meningkatkan pengalaman manusia, dengan agen AI yang mampu mengelola tugas sederhana dan membantu agen manusia pada masalah yang kompleks". Tetap melibatkan manusia dalam loop di mana itu paling penting, dan biarkan AI menangani sisanya dalam pagar pembatas tata kelola baru Anda.

Pertanyaan yang Sering Diajukan

Apa sebenarnya AIUC-1?

AIUC-1 adalah standar industri baru dan kerangka kerja sertifikasi untuk "agen" AI (bot perangkat lunak dan asisten) yang mencakup semua kategori risiko utama. Ini dibuat oleh para ahli dari perusahaan seperti Microsoft, Cisco, JPMorgan Chase, UiPath dan ElevenLabs untuk memberi perusahaan kerangka kerja yang jelas (seperti "SOC 2" untuk AI) saat mengevaluasi sistem AI. Dengan memenuhi persyaratan AIUC-1, produk AI menunjukkan telah diuji untuk keamanan, privasi data, keandalan, dan kekhawatiran lainnya.

Masalah data dan privasi apa yang ditangani AIUC-1?

Standar ini mewajibkan kontrol spesifik pada penggunaan menetapkan kebijakan tertulis untuk data input dan output AI (termasuk pelatihan, retensi, penghapusan dan opt-out pelanggan); membatasi AI dari mengakses data yang tidak relevan atau berlebihan; dan menambahkan perlindungan terhadap kebocoran data pribadi, IP atau pencampuran data dari pelanggan yang berbeda. Singkatnya, ini memaksa organisasi untuk mengunci bagaimana data pelanggan mengalir melalui AI mereka, mencegah jenis pelanggaran privasi yang menghancurkan kepercayaan.

Bagaimana sertifikasi AIUC-1 membangun kembali kepercayaan pelanggan?

Mendapatkan sertifikasi AIUC-1 (dan diasuransikan) memberi sinyal kepada pelanggan bahwa sistem AI telah lulus pengujian ketat terhadap mode kegagalan yang diketahui. Ini seperti menunjukkan laporan inspeksi keselamatan untuk AI Anda. Perusahaan kemudian dapat dengan jujur memberi tahu pelanggan: "AI kami memiliki perlindungan yang dapat diverifikasi dan bahkan cakupan asuransi." Pengadopsi awal melaporkan bahwa kredibilitas ini mempercepat kontrak dan penerapan. Dalam praktiknya, sertifikasi berarti lebih sedikit kesalahan merek – dan jika insiden terjadi meskipun ada sertifikasi, asuransi dapat menutupi dampaknya. Loop akuntabilitas ini adalah yang mengubah AI dari perjudian yang tidak diketahui menjadi layanan terkelola di mata pemimpin bisnis dan pelanggan.

Apa yang terjadi jika kami melewatkan standar ini?

Mengabaikan tata kelola AI membuka pintu air kepercayaan. Tanpa kebijakan atau pengujian yang jelas, agen AI dapat membocorkan data, melanggar hak cipta atau memberikan saran yang sangat buruk. Pelanggan akan menyadari – misalnya, bot yang memberikan jawaban yang tidak konsisten atau menyesatkan akan mengikis loyalitas. Regulator dan industri juga memperketat pengawasan. Perusahaan yang "AI-wash" (berpura-pura menggunakan AI tanpa kontrol yang tepat) berisiko tindakan hukum: SEC dan FTC telah mengenai sanksi kepada perusahaan karena klaim AI yang menipu. Singkatnya, melewatkan standar berarti risiko kerusakan merek, denda kepatuhan, dan kehilangan pelanggan.

Bagaimana pemimpin CX dapat mulai mengadopsi praktik AIUC-1?

Mulai dengan menginventarisasi alat AI dan aliran data Anda: klasifikasikan sistem mana yang menangani data pelanggan atau berinteraksi dengan pelanggan, dan bandingkan dengan daftar periksa kontrol AIUC-1. Kembangkan atau perbarui kebijakan privasi data AI Anda (mencakup input, output, retensi dan hak pelanggan). Bekerja dengan tim keamanan dan hukum Anda untuk menerapkan kontrol teknis yang diperlukan (misalnya minimisasi data, enkripsi, pemantauan). Libatkan auditor AIUC-1 terakreditasi sejak awal untuk mengukur aset AI Anda – konsorsium AIUC-1 menawarkan panduan tentang di mana setiap kontrol berlaku. Bahkan jika sertifikasi penuh adalah tujuan jangka panjang, gunakan persyaratan standar sebagai analisis kesenjangan untuk menguatkan sistem AI Anda sekarang. Akhirnya, terus berkomunikasi dengan pemangku kepentingan (dan pelanggan) saat Anda meningkat: transparansi tentang upaya ini sendiri akan membantu membangun kembali kepercayaan pada inisiatif AI Anda.

Poin Penting yang Dapat Ditindaklanjuti:

- Tentukan kebijakan data yang jelas: Tuliskan bagaimana AI akan menggunakan data pelanggan untuk pelatihan vs. inferensi, tetapkan batas retensi, dan tawarkan hak opt-out/penghapusan.

- Adopsi AIUC-1 sebagai kerangka kerja: Gunakan prinsipnya untuk menyatukan pemeriksaan keamanan, privasi, dan keselamatan di semua proyek AI. Pertimbangkan untuk memandu sertifikasi untuk agen AI berisiko tinggi.

- Berkolaborasi lintas tim: Hancurkan silo dengan melibatkan IT, hukum, kepatuhan dan CX dalam keputusan peluncuran AI. Perlakukan manajemen risiko AI sebagai misi bersama.

- Sematkan keamanan berdasarkan desain: Sebelum peluncuran, uji stres agen AI (red-teaming, injeksi prompt) dan terapkan pagar pembatas runtime (modulasi, peringatan anomali) untuk mencegah kebocoran atau perilaku salah.

- Manfaatkan asuransi AI: Cari vendor AI dengan sertifikasi AIUC-1 atau dukungan asuransi. Ini menyelaraskan insentif dan memberikan perlindungan finansial jika AI salah.

- Transparan dengan pengguna: Informasikan pelanggan ketika AI digunakan dan beri tahu mereka bagaimana data mereka ditangani, mengambil dari praktik Copilot Microsoft tentang pengungkapan waktu nyata.

- Kumpulkan hanya data yang diperlukan: Utamakan kualitas daripada kuantitas. Karena pengguna menuntut privasi, kumpulkan hanya informasi yang diperlukan untuk layanan dan jelaskan dengan jelas bagaimana itu meningkatkan pengalaman mereka.

- Latih dan pantau staf: Pastikan tim yang menghadapi pelanggan memahami keterbatasan AI dan memiliki jalur eskalasi yang jelas. Lacak metrik CX pasca peluncuran AI untuk menangkap masalah (seperti respons lambat atau ketidakpuasan) sejak awal.

Dengan mengatasi risiko AI secara langsung dan mengadopsi kerangka kerja seperti AIUC-1, pemimpin CX dan EX dapat menutup kesenjangan kepercayaan. Dalam lanskap perjalanan yang terfragmentasi dan evolusi AI yang cepat, inilah cara perusahaan bergerak dari eksperimen yang hati-hati ke penerapan AI yang percaya diri dan berpusat pada pelanggan.

Posting AIUC-1: The New Gold Standard for Trustworthy Enterprise AI muncul pertama kali di CX Quest.

Anda Mungkin Juga Menyukai

Pejabat Fed Masih Melihat Ruang untuk Pemotongan Suku Bunga Sebelum Akhir 2026

Tok-Edge Meluncurkan 'Redemption Token' untuk Mendukung Peluncuran Dana Kripto Senilai $21 Juta